Cómo crear una IA más humilde: el desafío de enseñar límites a las máquinas. La historia parte de un reporte de MIT News - AI sobre un caso centrado en confianza, explicación y límites de los modelos de IA, con un dato concreto que vuelve visible el tema del título: cómo crear una IA más humilde: el desafío de enseñar límites a las máquinas.

Qué pasó

La novedad llega desde MIT News - AI, que publicó el tema bajo el título original "How to create “humble” AI". El eje concreto es confianza, explicación y límites de los modelos de IA: no una idea abstracta, sino un caso con protagonistas, herramientas y una consecuencia verificable.

El dato que conviene retener es el cruce entre el caso puntual y su sistema: confianza, explicación y límites de los modelos de IA. A partir de ahí, la nota se vuelve interesante porque permite mirar el mecanismo que hay debajo del titular. Quién observa, qué mide, qué archivo o tecnología interviene y por qué ese cambio importa fuera del círculo de especialistas.

El detalle loco

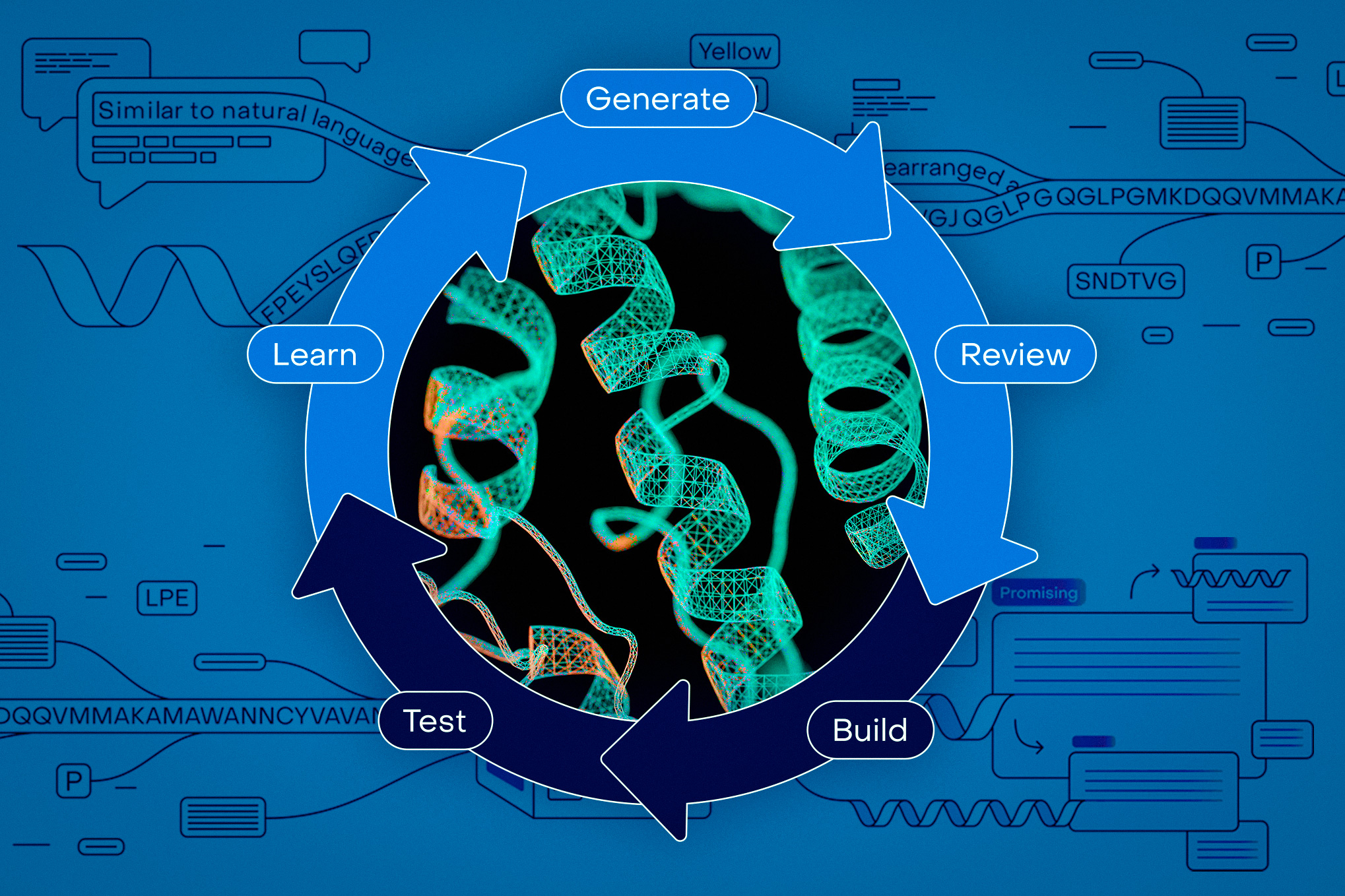

El detalle loco es que la parte más importante no es que el modelo responda, sino que pueda mostrar cuándo no debería hacerlo con tanta seguridad. En esta historia, el asombro no depende de exagerar el hallazgo, sino de mirar con precisión la pieza rara: cómo crear una IA más humilde: el desafío de enseñar límites a las máquinas.

La parte decisiva es que la tecnología no reemplaza automáticamente el criterio: lo desplaza hacia otro lugar. Ahora la pregunta es cómo se entrenó, cómo se evalúa y qué errores quedan escondidos detrás de una interfaz prolija.

Análisis

En IA, el error peligroso no siempre es la respuesta equivocada: muchas veces es la respuesta equivocada dicha con tono de certeza.

También hay una segunda lectura: cómo diseñar sistemas que no solo produzcan resultados, sino que ayuden a medir su propia confiabilidad. Esa pregunta es la que separa el dato pintoresco del análisis. No alcanza con decir que algo es raro; hay que entender qué revela sobre ciencia, cultura, tecnología, memoria o ambiente.

En este caso, la fuente funciona como punto de partida, no como cierre. La información relevante está en conectar el titular con sus condiciones: qué institución lo produce, qué método lo sostiene, qué límites tiene y qué conversación abre.

Por qué importa

Importa porque cómo crear una IA más humilde: el desafío de enseñar límites a las máquinas muestra a la IA en una escena concreta, lejos del marketing general. Ahí se puede discutir lo que realmente pesa: precisión, sesgos, supervisión, costo, acceso y responsabilidad.

Para leerla bien hay que evitar dos extremos. Uno es venderla como revolución automática. El otro es tratarla como anécdota menor. Entre ambos aparece una lectura más útil: qué cambia si este dato, herramienta o descubrimiento empieza a circular, a repetirse o a usarse en otros contextos.

Esa es la línea editorial que vale sostener: curiosidad con evidencia, sorpresa con contexto y análisis sin inflar lo que la fuente no dice.

Fuente original: MIT News - AI