Los modelos de lenguaje grandes —GPT, Claude, Gemini— aprendieron a predecir la próxima palabra. Eso los hizo extraordinariamente útiles para escribir, razonar en texto y responder preguntas. También los hizo fundamentalmente limitados para hacer algo que un robot necesita: entender que si empujás un vaso, cae.

Esa limitación es el punto de partida de lo que la revista Nature llamó esta semana "la última sensación de la IA": los modelos de mundo (world models). Y en los últimos doce meses, el campo recibió más de mil doscientos millones de dólares en financiamiento, publicaciones en revistas científicas de primer nivel y la atención de prácticamente todos los grandes laboratorios del planeta.

Qué es un modelo de mundo

Un modelo de mundo es un sistema de inteligencia artificial entrenado para predecir qué va a pasar después en el mundo físico, no en el texto. En lugar de procesar cadenas de palabras, procesa video, imágenes en 3D, datos de sensores, y aprende a simular internamente las consecuencias de distintas acciones.

La distinción técnica es importante. Un modelo de lenguaje que "sabe" que la gravedad hace caer los objetos lo sabe de manera inferencial: leyó muchas frases donde eso ocurre. Un modelo de mundo que "sabe" lo mismo lo modeló a partir de millones de escenas reales donde vio objetos caer, rebotar, deslizarse y detenerse. El conocimiento es fundamentalmente distinto: uno es estadístico sobre palabras, el otro es simulación sobre física.

La consecuencia práctica es que los modelos de mundo pueden "imaginar" hacia adelante. Antes de que un robot mueva un brazo, puede simular internamente varias trayectorias posibles y elegir la que mejor funcione. Antes de que un sistema autónomo tome una decisión, puede proyectar consecuencias en un entorno virtual.

El dinero y los nombres

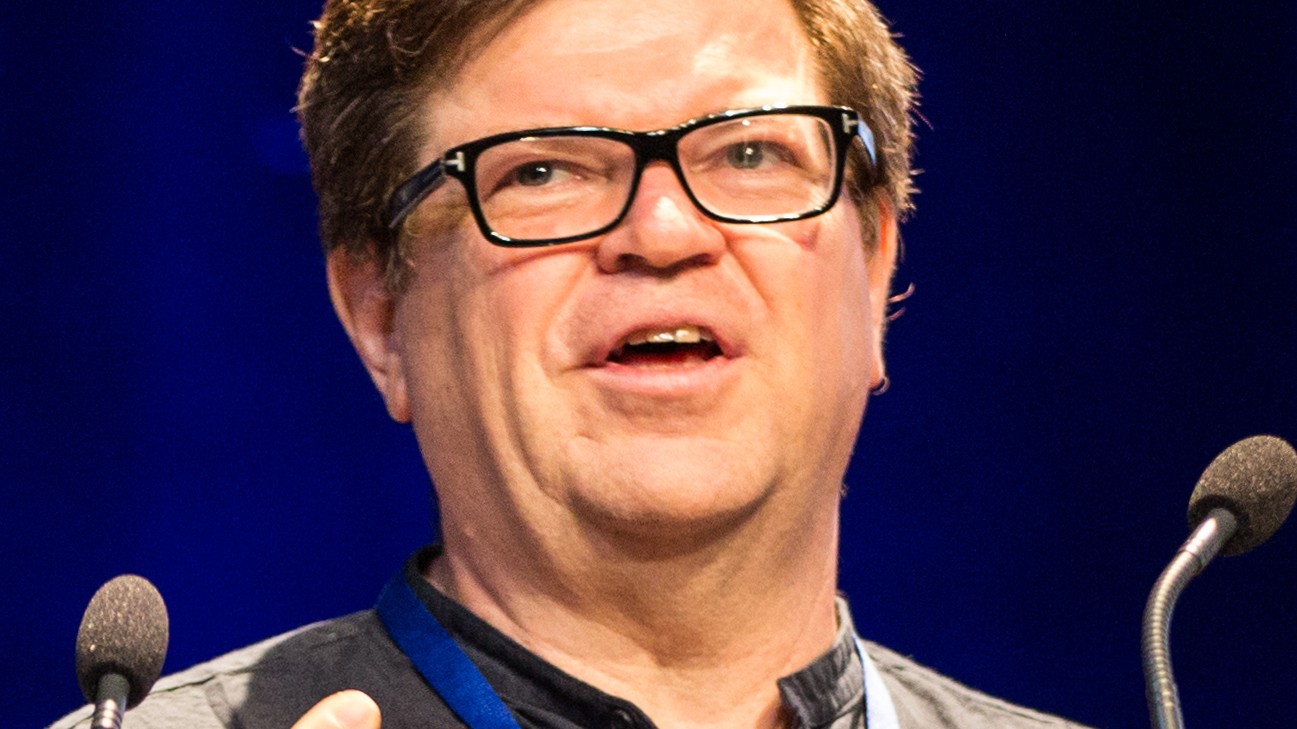

El interés va mucho más allá de lo académico. En marzo de 2026, Yann LeCun —ganador del Premio Turing, exdirector de investigación en Meta y el crítico más conocido de los modelos de lenguaje— lanzó AMI Labs (Advanced Machine Intelligence), un laboratorio dedicado exclusivamente a desarrollar modelos de mundo. La ronda de financiamiento inicial fue de mil treinta millones de dólares, a una valuación de tres mil quinientos millones. Las oficinas están en París, Nueva York, Montreal y Singapur.

LeCun lleva años argumentando que los grandes modelos de lenguaje son un callejón sin salida para la inteligencia artificial general. Su apuesta es que la próxima arquitectura relevante no va a predecir palabras sino mundos. AMI Labs es la puesta en práctica de esa tesis con capital real.

Fei-Fei Li —creadora de ImageNet, el dataset que desencadenó la revolución del aprendizaje profundo— fundó World Labs y en noviembre de 2025 lanzó Marble, un modelo capaz de generar mundos tridimensionales completos a partir de una descripción de texto, una imagen, o un video. La compañía recaudó doscientos treinta millones de dólares.

Google DeepMind publicó Genie 3, disponible para usuarios de Google AI Ultra, que simula entornos físicos dinámicos y se aplica a robótica, animación y modelado histórico. NVIDIA lanzó Cosmos, una familia de modelos entrenados sobre datos físicos del mundo real, con el objetivo explícito de entrenar robots que operen en entornos no controlados.

El director técnico de NVIDIA resumió el momento con una frase deliberadamente provocativa: "El ChatGPT de la robótica ya llegó."

Por qué los LLMs no alcanzan

El artículo de Nature ilustra la limitación con un ejemplo preciso: un modelo de lenguaje entrenado para dar instrucciones de taxi falla cuando el camino habitual está cortado. Tiene que improvisar una ruta alternativa, y ahí colapsa. No tiene modelo del espacio, solo patrones de texto.

Un modelo de mundo entrenado sobre mapas, recorridos reales y datos de movimiento construye una representación del espacio y puede razonar sobre rutas alternativas sin haberlas visto antes. La diferencia no es de tamaño —no es que necesitás más parámetros— sino de arquitectura y tipo de datos.

Esta es la crítica de fondo de LeCun al paradigma dominante: el lenguaje es una proyección de la realidad, no la realidad misma. Entrenar IA sobre texto es entrenarla sobre sombras.

Las aplicaciones concretas

La robótica es el caso de uso más obvio. Un robot que puede simular internamente los efectos de sus propias acciones aprende mucho más rápido que uno que depende de prueba y error en el mundo físico. NVIDIA, Boston Dynamics, Figure AI y otros laboratorios de robótica están usando modelos de mundo para entrenar humanoides que puedan trabajar en fábricas, almacenes y hogares.

Pero la aplicación se extiende más allá. En healthcare, los modelos de mundo se están usando para simular la progresión de enfermedades. En videojuegos y entretenimiento, para generar mundos interactivos. En vehículos autónomos, para anticipar el comportamiento de peatones y otros conductores en situaciones inusuales.

La pregunta que los investigadores no están respondiendo todavía —al menos no públicamente— es cuándo un modelo de mundo se vuelve suficientemente bueno como para que la diferencia con un entorno real desaparezca. Cuando eso ocurra, el entrenamiento de sistemas físicos se podrá hacer enteramente en simulación.

El momento

Lo que hace notable este momento es la convergencia. Los datos de video a escala masiva existen. La potencia de cómputo para procesarlos existe. Las arquitecturas para entrenar representaciones espacio-temporales existen. Y el capital para financiar laboratorios que los combinen existe.

LeCun, Fei-Fei Li, DeepMind y NVIDIA apostaron al mismo tiempo a que la próxima transición grande en IA no va a ser el próximo modelo de lenguaje más grande, sino el primero que entienda para qué sirve la física.

Fuente original: Nature / MIT Technology Review / Scientific American