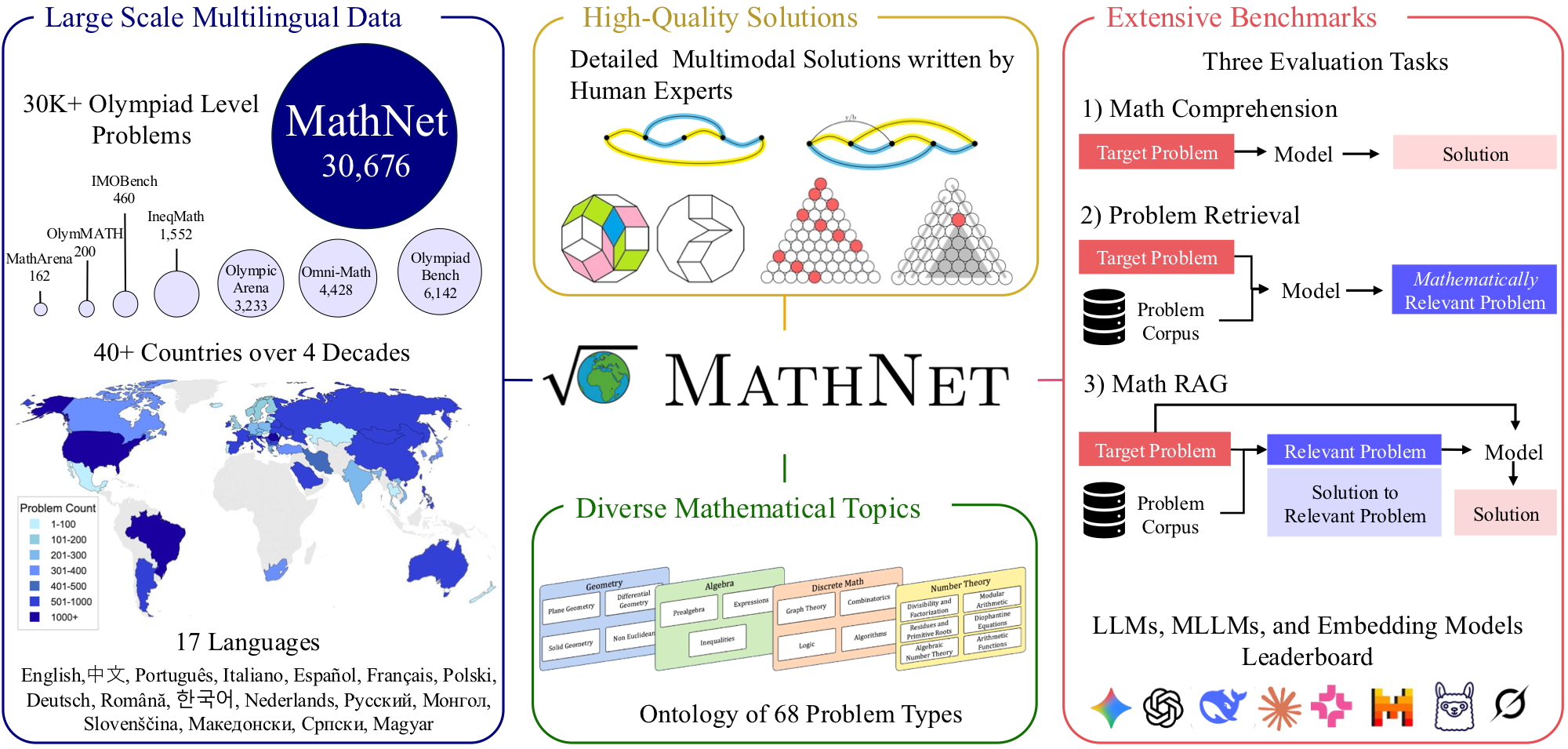

El 24 de abril de 2026, un equipo de MIT CSAIL, King Abdullah University of Science and Technology (KAUST) y la empresa HUMAIN presentó MathNet, un banco público de problemas olímpicos pensado para medir hasta dónde llega de verdad la IA matemática. Importa porque cambia el terreno de prueba: en vez de ejercicios breves y homogéneos, usa cuadernillos oficiales, soluciones largas, varios alfabetos, diagramas y tradiciones nacionales distintas para resolver una misma idea.

El dato central está en la escala y en el resultado. MathNet reúne 30.676 problemas con soluciones procedentes de 143 competencias de 47 países y 17 idiomas, armados a partir de 1.595 volúmenes PDF y más de 25.000 páginas. En el test principal de 6.400 ejercicios, Gemini-3.1-Pro llega al 78,4% y GPT-5 al 69,3%; en recuperación de problemas equivalentes, ningún modelo supera un Recall@1 del 5%. La colección es cinco veces mayor que el siguiente dataset comparable y deja una conclusión menos cómoda que muchos titulares sobre “IA olímpica”: acertar bastante no significa entender bien el mapa.

1.595 cuadernillos oficiales, no ejercicios de foro

La base de MathNet no salió de hilos comunitarios ni de recopilaciones armadas por aficionados, sino de cuadernillos oficiales de olimpiadas nacionales e internacionales. Ahí está una de sus diferencias fuertes. En muchos benchmarks previos, los problemas provienen de repositorios como Art of Problem Solving, útiles para entrenar, pero menos controlados en formato, metadatos y calidad de las soluciones. MathNet eligió otra cosa: tomar el material que cada delegación lleva a competencias como la International Mathematical Olympiad y convertirlo en un corpus estable.

El trabajo de archivo fue menos glamoroso que la tabla de resultados. Shaden Alshammari, autora principal, y sus colegas tuvieron que rastrear miles de páginas en múltiples idiomas, desde archivos digitales nítidos hasta escaneos viejos y desparejos. Una parte decisiva vino de Navid Safaei, figura histórica de la comunidad olímpica, que llevaba coleccionando y escaneando cuadernillos desde 2006. El paper también lleva las firmas de Kevin Wen, Abrar Zainal, Mark Hamilton, Sultan Albarakati, William T. Freeman y Antonio Torralba.

La limpieza tampoco quedó librada a una tubería automática. El sitio del proyecto explica que cada cuadernillo pasó por OCR, segmentación de documento, alineación entre problema y solución, normalización de formato con GPT-4.1 y verificación humana. Para validar el conjunto, el equipo reunió además a más de 30 evaluadores de países como Armenia, Rusia, Ucrania, Vietnam y Polonia. El resultado no es sólo grande: también intenta conservar la lógica interna de cada problema.

El idioma también cambia la dificultad

El atractivo de MathNet no está únicamente en sumar volumen. Está en mostrar que la matemática de competencia no circula en una sola lengua ni con una sola manera de plantear preguntas. El sitio del proyecto informa que el corpus tiene un 74% de problemas en inglés y un 26% en idiomas no ingleses, distribuidos entre lenguas romances, eslavas, germánicas, CJK y otros grupos donde aparecen, por ejemplo, el mongol y el húngaro.

Eso vuelve visible un límite incómodo para varios modelos abiertos. Según MIT, algunos obtuvieron 0% en problemas en mongol. No porque el teorema cambie de país a país, sino porque cambian la notación, el estilo de exposición y la forma de encuadrar una idea matemática. Un problema de combinatoria rumano o uno de teoría de números brasileño pueden atacar el mismo núcleo formal desde tradiciones distintas. Para una IA, esa diferencia pesa.

Los dibujos siguen siendo un cuello de botella

Una parte del corpus incluye problemas con figuras, algo que todavía complica a los modelos que parecen sólidos en pruebas puramente textuales. MIT subraya que, cuando entra un diagrama, el rendimiento cae en casi todos los sistemas evaluados. Tiene sentido: una olimpiada no pide sólo recordar un método, también exige leer una construcción geométrica, distinguir relaciones espaciales y decidir qué parte del dibujo es esencial y cuál es mero apoyo visual.

Ahí se nota por qué MathNet se presenta como benchmark multimodal. No alcanza con procesar palabras si el problema mezcla texto, notación y figura. El modelo tiene que unir esas capas sin inventar relaciones que no están. En la práctica, esa es una de las zonas donde la distancia entre resolver una batería de ejercicios de entrenamiento y enfrentarse a una prueba seria vuelve a abrirse.

Encontrar el problema gemelo sigue siendo difícil

La parte más rara del proyecto no es pedirle a un modelo que resuelva un ejercicio, sino que encuentre otro ejercicio matemáticamente equivalente dentro de una gran piscina de problemas. Para eso, MathNet armó un benchmark de recuperación sobre 10.000 problemas ancla. El mejor Recall@1 publicado por el sitio es 4,96, para qwen3-embedding-4B; gemini-embedding-001 queda en 4,83. El Recall@5 mejora bastante, pero el primer intento sigue siendo flojo.

Ese dato importa fuera del laboratorio. En la comunidad olímpica, detectar si un problema nuevo es realmente original o si ya apareció disfrazado con otra notación es una tarea difícil incluso para comités expertos. MathNet convierte ese problema editorial y matemático en una prueba de retrieval. Y la IA, por ahora, no luce demasiado cómoda ahí.

El tercer bloque del benchmark combina ambas cosas: primero recuperar un problema afín y después usarlo como contexto para resolver uno nuevo. A veces ayuda mucho. DeepSeek-V3.2-Speciale pasa de 84,8% a 97,3% cuando recibe recuperación experta. Pero la mejora depende de que el ejemplo recuperado sea realmente pertinente. MIT informa que la recuperación irrelevante degradó el rendimiento en alrededor de 22% de los casos analizados.

Un banco para entrenar, pero también para auditar

MathNet sirve para entrenar modelos, sí, pero también para auditar promesas. La colección quedó abierta al público, de modo que un estudiante que prepara la IMO o una olimpiada nacional puede navegar problemas y soluciones. Al mismo tiempo, el benchmark obliga a distinguir entre resolver bien una muestra estrecha y responder con consistencia cuando cambian idioma, formato y longitud.

Ese punto conecta con discusiones más amplias sobre cómo se documentan y se miden los sistemas de IA. No alcanza con mirar una demo brillante; importa de dónde sale el corpus, qué deja afuera y qué significa exactamente “rendir bien”, igual que en las model cards o en los datasets con etiqueta nutricional.

La pregunta que abre MathNet no es si una IA ya “sabe matemáticas” en abstracto. Es más concreta y más difícil: si todavía falla al leer figuras, tropieza con idiomas menos frecuentes y casi nunca detecta a la primera un problema equivalente, ¿qué tan cerca está de ayudar a escribir, verificar o auditar matemáticas originales en entornos donde una pequeña diferencia formal cambia toda la solución?

Fuente original: MathNet (MIT CSAIL)