La inteligencia artificial entra en la guerra por muchas puertas: análisis de imágenes, logística, vigilancia, predicción, selección de objetivos, defensa aérea, ciberoperaciones y apoyo a decisiones. El problema no es que toda IA militar sea igual ni que todo uso sea ilícito. El problema aparece cuando la promesa de velocidad reduce el espacio para juicio humano, verificación y responsabilidad.

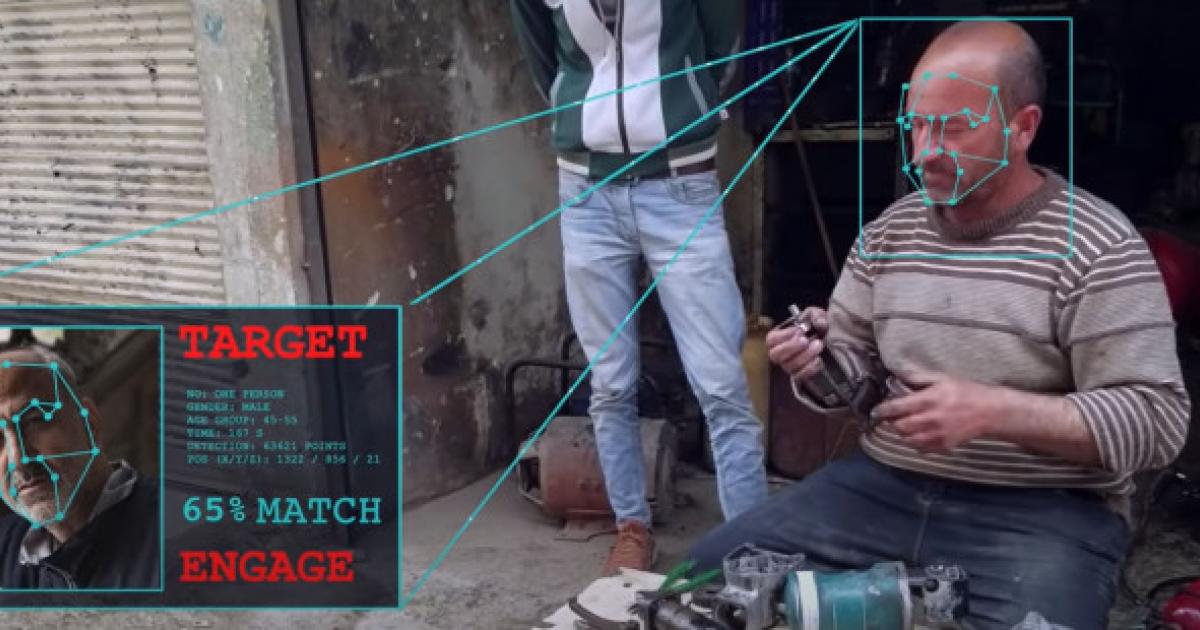

La automatización de la sospecha

Un sistema puede ordenar miles de imágenes, detectar patrones o sugerir amenazas. Eso puede ayudar en tareas donde el volumen de datos supera a cualquier equipo humano. Pero una sugerencia algorítmica no es una verdad. Si se convierte en blanco por inercia, la máquina pasa de asistir a empujar decisiones.

Datos de guerra, datos sucios

En conflicto, la información llega incompleta, vieja, sesgada o manipulada. Edificios cambian de uso, personas se desplazan, señales se ocultan, imágenes se degradan y actores intentan engañar sensores. Una IA entrenada en condiciones limpias puede fallar justo donde más importa.

La ilusión de objetividad

Los sistemas técnicos suelen presentarse como neutrales. Pero su diseño incluye supuestos: qué cuenta como amenaza, qué fuentes pesan más, qué errores se toleran, qué umbral activa una alerta. En guerra, esos supuestos pueden convertirse en vida o muerte.

Humanos dentro y fuera del circuito

La frase 'humano en el circuito' no alcanza si el humano solo confirma recomendaciones a gran velocidad, sin información suficiente o bajo presión. El control significativo requiere tiempo, autoridad real para decir no, comprensión del sistema y posibilidad de rendir cuentas.

La pregunta ética

La pregunta ética no es si una IA puede mejorar alguna tarea militar. La pregunta es qué decisiones no deben acelerarse hasta perder deliberación. La vida civil no puede depender de una interfaz que convierta incertidumbre en confianza visual.

Por qué importa

Cierra la serie con una nota fuerte sobre IA, noosfera y guerra. Es actual, profunda y alineada con lo que puede diferenciar a Un Mundo Loco: explicar tecnología con consecuencias humanas.

También en Un Mundo Loco: Armas autónomas y La noosfera.

Fuente original: ICRC

Imágenes: Wikimedia Commons (ICRC, Wikimedia Commons y archivo local).