El 16 de abril de 2026, Google Research presentó MoGen, un modelo generativo diseñado para producir neuronas sintéticas en 3D y entrenar con ellas sistemas que reconstruyen mapas cerebrales. El trabajo, firmado por Franz Rieger, Jan-Matthis Lueckmann, Viren Jain y Michal Januszewski, será presentado en ICLR 2026. Importa porque el gran cuello de botella de la conectómica ya no está sólo en obtener imágenes del tejido, sino en corregir a mano los errores de los modelos que intentan convertir esos cortes microscópicos en neuronas completas.

El dato fuerte no está en una promesa abstracta, sino en una cuenta concreta. Según Google Research y el paper publicado en OpenReview, sumar ejemplos generados por MoGen redujo en 4,4% los errores de reconstrucción del sistema PATHFINDER. Puede parecer un margen pequeño, pero a escala de un cerebro completo de ratón equivale a ahorrar más de 157 años-persona de revisión manual. La comparación sirve para medir el problema: el mapa completo del cerebro y el sistema nervioso central de una mosca de la fruta macho tiene 166.000 neuronas; Google recuerda que un cerebro de ratón es unas 1.000 veces mayor, y uno humano otras 1.000 veces más grande.

El atasco aparece después del microscopio

La conectómica busca reconstruir el cableado del cerebro célula por célula. El procedimiento empieza con cortes ultrafinos de tejido, sigue con imagen microscópica de alta resolución y después apila, alinea y segmenta esas imágenes para convertirlas en formas neuronales tridimensionales.

Los modelos fallan en dos lugares muy concretos. A veces separan fragmentos que deberían estar unidos; Google llama a eso split errors. Otras veces fusionan por error ramificaciones que pertenecen a neuronas distintas; son los merge errors. El resultado no es un detalle cosmético. Cada error obliga a revisar manualmente trayectos minúsculos de axones y dendritas que se retuercen, se afinan, se bifurcan y se cruzan como si fueran espaguetis vistos al microscopio.

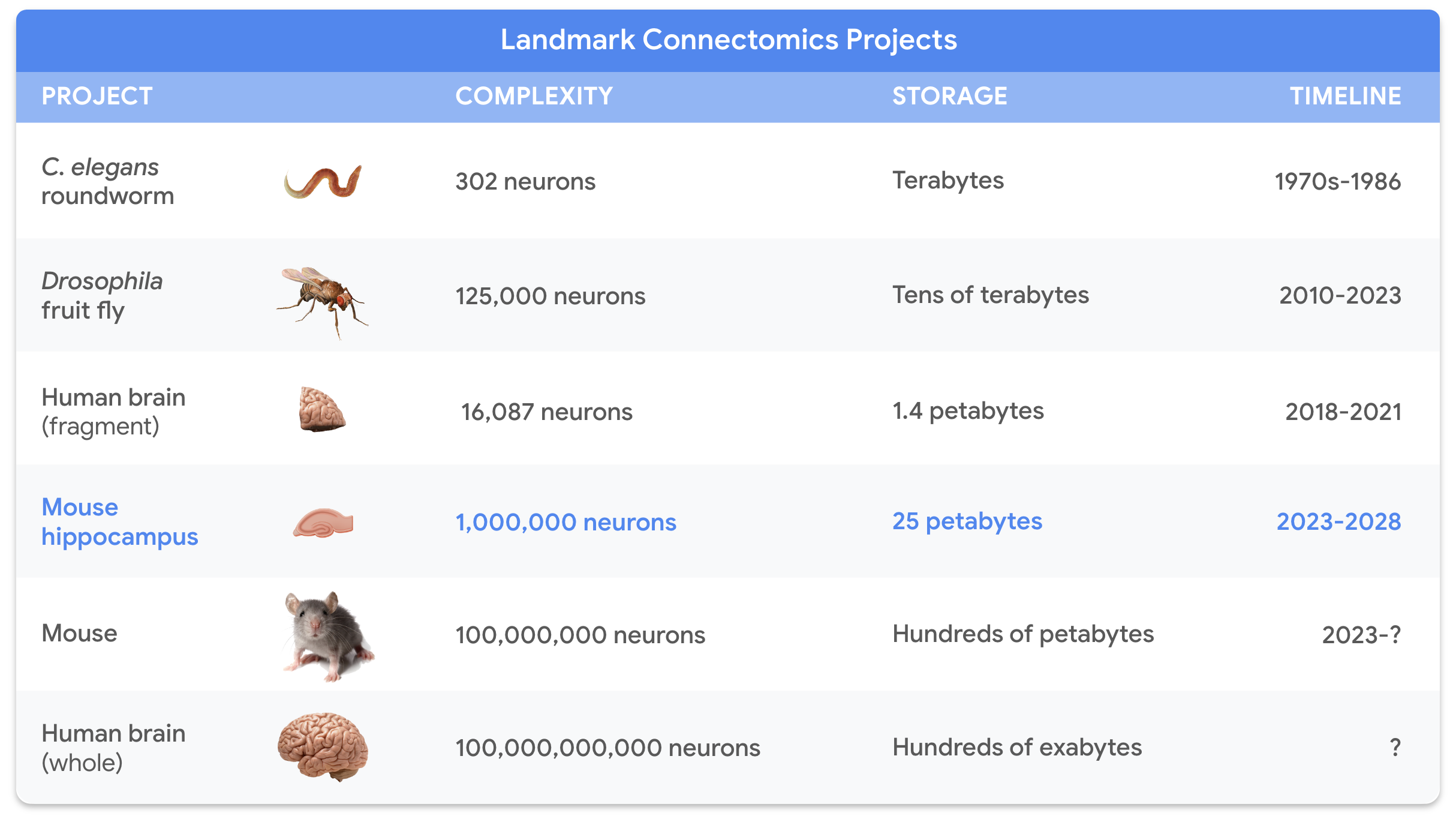

Ese trabajo de corrección sigue dependiendo de especialistas humanos. Por eso un proyecto puede tener máquinas rápidas, almacenamiento masivo y modelos sofisticados, pero aun así frenarse en la fase menos vistosa: la verificación. El propio sitio de Neural Mapping de Google muestra bien la escala histórica del problema. El conectoma de C. elegans, con 302 neuronas, tardó 16 años en completarse. En 2021, el conjunto H01 llevó esa lógica a una muestra de cerebro humano de alrededor de un milímetro cúbico y terminó convertido en un render de 1,4 petabytes.

Qué hace MoGen cuando “inventa” una neurona

MoGen no genera cerebros completos. Genera morfologías neuronales plausibles, en forma de nubes de puntos 3D, para reforzar el entrenamiento de otros modelos. Google entrenó el sistema con 1.795 axones de corteza de ratón ya verificados por humanos y usó una arquitectura de point cloud flow matching apoyada en el modelo PointInfinity.

En vez de pedirle a una IA que “dibuje” una neurona, el equipo le enseñó a transformar una nube aleatoria de puntos en geometrías que conserven rasgos biológicos creíbles: curvaturas, torsiones, engrosamientos, ramificaciones. Después, esas formas sintéticas se incorporan al entrenamiento de PATHFINDER, que es el sistema encargado de decidir si una reconstrucción neuronal tiene sentido estructural o si es probable que esconda una unión absurda o una separación falsa.

Para validar que MoGen no estaba generando ruido bonito, el equipo hizo una prueba simple: mezcló fragmentos reales con fragmentos sintéticos y pidió a expertos que los clasificaran. Según Google, los evaluadores no pudieron distinguir de forma fiable entre unos y otros. Si las formas generadas no fueran convincentes, el modelo posterior aprendería errores y empeoraría el problema en vez de reducirlo.

El 10% artificial que movió la aguja

La mejora no vino de reemplazar datos reales, sino de usarlos mejor. Google informa que el mejor resultado apareció cuando 10% del entrenamiento de PATHFINDER incluyó muestras simuladas por MoGen. Con esa mezcla, la tasa de error bajó 4,4%, impulsada sobre todo por una caída de los merge errors, los fallos más engorrosos de corregir porque conectan por accidente ramas que nunca debieron tocarse.

En el paper hay otro detalle útil: la reducción se calcula sobre reconstrucciones reservadas de axones de ratón, no sobre ejemplos reciclados del entrenamiento. Eso vuelve más defendible la cifra. También explica por qué una mejora modesta en porcentaje puede volverse enorme en costo humano. Cuando el objetivo ya no es un fragmento de laboratorio sino una fracción grande de un cerebro mamífero, cada punto de error arrastra meses o años de revisión.

Google ya venía construyendo infraestructura para esta clase de proyectos. El sitio institucional recuerda que en 2020 la empresa y sus colaboradores publicaron el fruit fly hemibrain, con unas 125.000 neuronas, y que en 2023 lanzaron junto con otros grupos un proyecto para mapear entre 2% y 3% del cerebro de ratón durante cinco años, con foco en el hipocampo. Esa iniciativa está ligada al National Institutes of Health y a la BRAIN Initiative. En ese contexto, ahorrar 157 años-persona no es una metáfora de prensa: es una forma de volver ejecutable una tarea que, de otro modo, escala peor que los modelos.

De la mosca al ratón, y del ratón al archivo

MoGen también deja ver un cambio más amplio en la investigación con IA. Durante años, la promesa fue que los modelos reconocerían mejor las formas reales. Acá el truco es otro: fabricar datos plausibles para enseñarles a reconocer lo real con menos tropiezos. No se usa la generación como espectáculo visual, sino como herramienta de mantenimiento para una tubería científica.

El alcance todavía es acotado. El paper trabaja con axones y dendritas de ratón, y Google aclara que distintas especies tienen morfologías neuronales distintas. Por eso también entrenaron variantes sobre neuronas de pinzón cebra y mosca de la fruta, y exploran si esas simulaciones pueden extenderse a imágenes sintéticas de microscopía electrónica más arriba en la cadena de procesamiento. Además, liberaron MoGen como modelo abierto con versiones entrenadas por especie.

La pregunta de fondo no es si una IA puede “entender” un cerebro. Está bastante antes. Es si puede ayudar a construir mapas suficientemente limpios como para que otros investigadores encuentren patrones reales en ellos. Si un 4,4% ya mueve la escala del trabajo manual, el próximo problema técnico no será conseguir más imágenes, sino decidir qué otras partes del pipeline conviene volver sintéticas antes de que el archivo del cerebro crezca más rápido que la capacidad humana de corregirlo.

Fuente original: Google Research