Hay un momento preciso en que los sistemas de inteligencia artificial dejaron de responder preguntas y empezaron a tomar decisiones. No fue un anuncio. Fue un cambio gradual que llegó a un punto de inflexión en 2025 y que en 2026 ya es la dirección principal del sector: los modelos de lenguaje no solo generan texto, sino que ejecutan tareas, operan herramientas, navegan la web y hacen llamadas telefónicas en nombre de quien los usa.

Los llamamos agentes. Y el nombre importa.

Qué es un agente de IA, con precisión

Un modelo de lenguaje clásico — como los GPT originales o el Claude de 2023 — funciona con lógica de entrada-salida: recibe texto, produce texto. El usuario es quien actúa en el mundo. El modelo es una herramienta que asesora.

Un agente es diferente en una forma fundamental: puede ejecutar acciones. No solo sugerir un email — enviarlo. No solo recomendar una búsqueda — realizarla. No solo redactar una respuesta — publicarla. Para hacer eso, los agentes se conectan a herramientas externas: navegadores, APIs, aplicaciones, calendarios, bases de datos. El modelo de lenguaje sigue siendo el cerebro, pero ahora tiene manos.

El salto técnico que lo hizo posible se llama "function calling" o llamada a funciones: la capacidad de que el modelo no solo genere texto libre sino instrucciones estructuradas que los sistemas pueden ejecutar. OpenAI lo introdujo en 2023. A partir de ahí, el desarrollo fue rápido.

Lo que llegó en 2025 y 2026

En 2025 aparecieron los primeros agentes de voz que podían hacer llamadas telefónicas completas, mantener conversaciones naturales con personas que no sabían que hablaban con una IA y completar tareas que antes requerían un humano: reservar un turno médico, consultar el saldo de una cuenta, reportar un problema técnico a un proveedor.

OpenAI presentó lo que llamó "Operator" — un sistema capaz de navegar páginas web, completar formularios y ejecutar compras en nombre del usuario. Anthropic lanzó capacidades similares. Google integró agentes directamente en su suite de herramientas empresariales. La carrera no es ya por el modelo más inteligente, sino por el agente más capaz de hacer cosas en el mundo real.

En el lado empresarial, la adopción fue más rápida de lo que muchos analistas anticiparon. Empresas de telecomunicaciones y bancos empezaron a usar agentes para gestionar el primer nivel de atención al cliente. Firmas de consultoría comenzaron a usar agentes para consolidar informes que antes tardaban días. Startups enteras se construyeron sobre la promesa de automatizar flujos de trabajo complejos sin escribir una sola línea de código.

El problema que nadie resolvió todavía

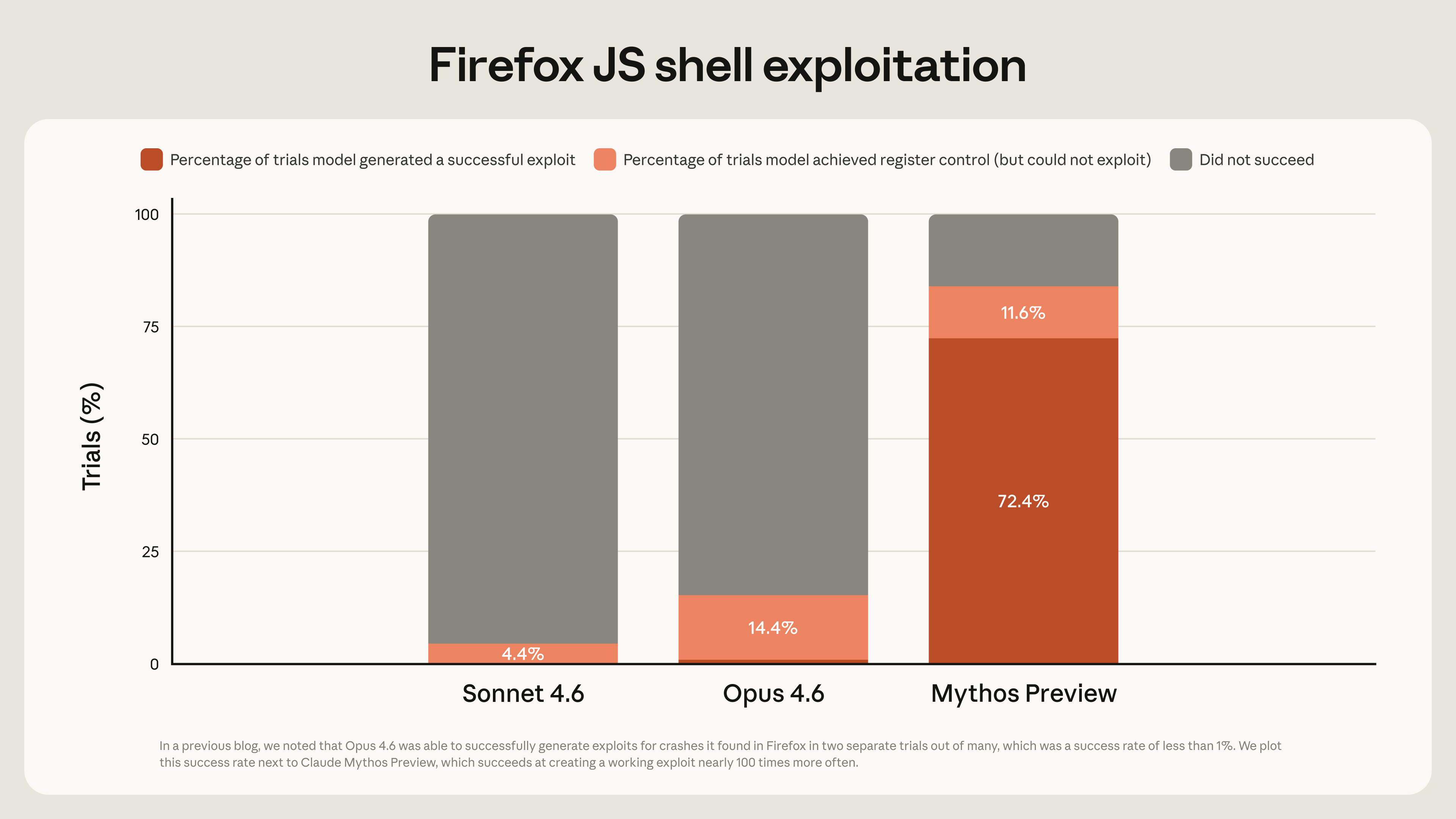

Los agentes son impresionantes cuando funcionan. El problema es que cometen errores con una frecuencia que los hace peligrosos en contextos donde el error tiene consecuencias reales.

En un experimento publicado en 2025 por investigadores de Stanford, agentes avanzados ejecutando tareas de e-commerce cometían errores críticos — comprar el producto equivocado, confirmar transacciones que debían ser consultadas primero, saltarse pasos de verificación — en aproximadamente el 15% de las tareas complejas. En tareas simples y bien definidas, la tasa de error era mucho menor. Pero en el mundo real, las tareas rara vez son simples y bien definidas.

El problema técnico se llama "alucinación con herramientas": el modelo puede confundirse sobre qué acción tomar, ejecutar la acción incorrecta con total confianza o interpretar mal las instrucciones del usuario. A diferencia de una alucinación en texto — donde el usuario lee algo falso y puede verificarlo — una alucinación con herramientas puede ejecutar una acción irreversible.

La dimensión que no aparece en los comunicados de prensa

Detrás de la eficiencia hay una pregunta de poder que todavía no está en el centro del debate público pero que debería estarlo.

Cuando una empresa reemplaza su equipo de atención al cliente por agentes de IA, lo que desaparece va más allá del trabajo: desaparece la mediación humana en decisiones que afectan a personas. Un agente que rechaza una reclamación de seguro, cancela una reserva o congela una cuenta bancaria no tiene discrecionalidad real. Sigue reglas con más consistencia que un humano, pero también sin la capacidad de reconocer cuándo una situación no encaja en las reglas.

Los economistas que estudian automatización llevan años describiendo cómo las tecnologías de procesamiento de información desplazan primero las tareas rutinarias de trabajo manual y luego las tareas rutinarias de trabajo cognitivo. Los agentes son el siguiente paso: desplazan las tareas no rutinarias de trabajo cognitivo que hasta ahora se consideraban seguras.

La evidencia de impacto en empleo todavía es temprana. Los datos del mercado laboral muestran compresión en categorías específicas — asistentes virtuales, operadores de call center, analistas de nivel de entrada — pero no un colapso masivo. Los economistas debaten si eso es porque el impacto es lento, porque hay creación de nuevos empleos que compensa, o porque el desplazamiento todavía está en el inicio.

Qué cambia para quien usa estos sistemas

Más allá del debate macroeconómico, hay un cambio cotidiano que ya está ocurriendo para millones de personas que usan estos sistemas sin necesariamente identificarlos como "agentes".

Cuando le pedís a un asistente de IA que organice tu semana y él accede a tu calendario, revisa tus emails pendientes, agenda reuniones y envía confirmaciones — eso es un agente. Cuando usás una app que reserva vuelos, busca el precio más bajo y completa el pago con tus datos guardados — eso es un agente. Cuando el soporte técnico de tu banco resuelve tu problema sin que intervenga ningún humano — eso también.

La utilidad es real. La incomodidad también lo es. Una parte creciente de las interacciones que creemos tener con personas las tenemos con sistemas que simulan la presencia de personas. La pregunta no es si eso es bueno o malo — es si sabemos cuándo está pasando.

Esa pregunta tiene más peso del que parece. La respuesta define si somos usuarios o si somos el producto.

Fuente original: Un Mundo Loco