Anthropic está intentando transformar una pelea política en una oportunidad de infraestructura. The Verge informa que Dario Amodei, CEO de la compañía, se reunió con funcionarios de la Casa Blanca mientras Anthropic promociona Claude Mythos Preview, un modelo orientado a ciberseguridad y disponible por acceso privado.

El contexto importa. La relación de Anthropic con sectores del gobierno estadounidense se había tensado después de que la empresa marcara límites sobre usos de su tecnología: vigilancia masiva doméstica y armas completamente autónomas sin humanos en el circuito. Esa posición derivó en acusaciones públicas, una designación como riesgo de cadena de suministro, una demanda y una medida judicial temporal.

Mythos como llave

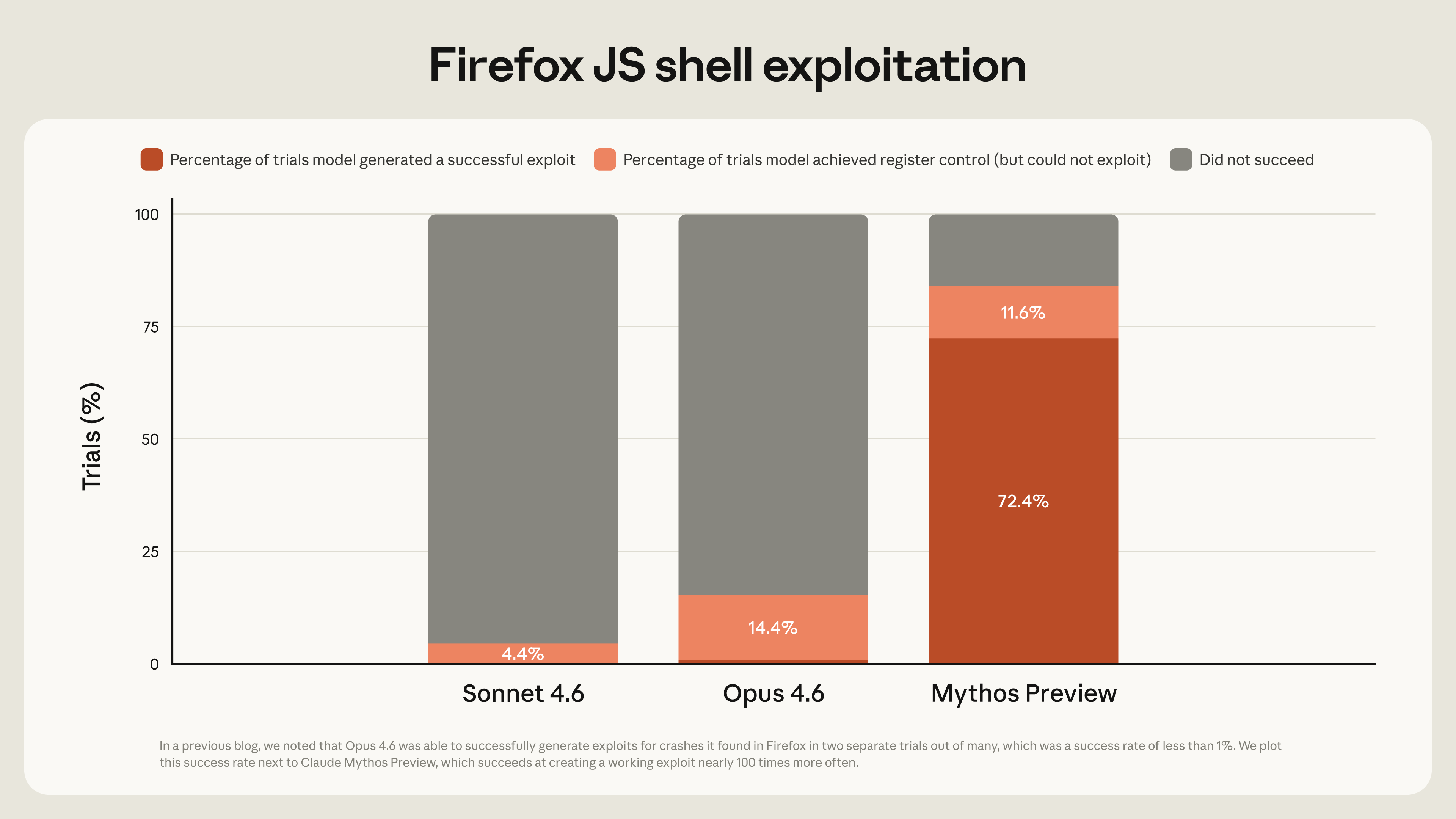

Claude Mythos Preview aparece como una herramienta capaz de detectar vulnerabilidades de alto impacto en infraestructura digital muy usada. Anthropic lo presenta como un modelo con capacidades ofensivas y defensivas de ciberseguridad. Empresas como Apple, Nvidia y JPMorgan Chase ya figuran entre los usuarios o interesados mencionados por The Verge.

Ese tipo de producto cambia el tono de la conversación. Un modelo general puede parecer una amenaza difusa. Un modelo que encuentra fallas antes que atacantes puede ser vendido como defensa nacional, resiliencia bancaria y protección de infraestructura crítica.

Seguridad y poder

La ciberseguridad es uno de los campos donde la IA tiene una doble lectura inmediata. Puede encontrar errores, escribir pruebas, acelerar auditorías y ayudar a equipos defensivos. Pero las mismas capacidades pueden apoyar exploración ofensiva, automatización de ataques o descubrimiento de vulnerabilidades antes de que los defensores lleguen.

Por eso el debate no se reduce a técnico. Si un modelo de este tipo entra en agencias, bancos y empresas críticas, la pregunta es quién controla el acceso, cómo se audita su uso y qué límites quedan escritos en contratos, no solo en comunicados.

La paradoja de Anthropic

Anthropic construyó parte de su marca alrededor de seguridad de IA. Ahora esa identidad se cruza con el uso gubernamental de modelos avanzados. La empresa puede argumentar que trabajar con el Estado permite orientar la tecnología hacia usos responsables. Sus críticos pueden responder que una vez que un modelo entra en circuitos de seguridad nacional, los incentivos cambian.

La tensión no tiene salida simple. Los gobiernos no van a dejar de usar IA. Las empresas tampoco van a abandonar un mercado tan grande. El punto será si las líneas rojas de Anthropic sobreviven a la presión comercial y política.

Qué queda abierto

Mythos Preview puede ser una herramienta seria si ayuda a cerrar fallas antes de que se exploten. También puede abrir una carrera por modelos cada vez más potentes para encontrar debilidades en sistemas críticos. La diferencia depende de gobernanza, trazabilidad y controles de acceso.

La noticia muestra una fase nueva de la IA: menos chat público, más infraestructura sensible. Los modelos ya no compiten solo por responder preguntas. Compiten por entrar en bancos, agencias, sistemas operativos y redes donde un error no es una alucinación graciosa, sino un problema real.

Fuente original: The Verge