El 10 de abril de 2026, a las cuatro de la madrugada, Daniel Moreno-Gama llegó desde Texas hasta San Francisco, se paró frente a la casa de Sam Altman, el CEO de OpenAI, y arrojó un cóctel Molotov. El artefacto prendió fuego a la reja exterior. Menos de una hora después, el mismo hombre se presentó frente a las oficinas de OpenAI, a tres kilómetros de distancia, y amenazó con incendiarlas.

Moreno-Gama tenía 20 años. Tenía publicaciones en Substack sobre los riesgos existenciales de la inteligencia artificial. Tenía una lista con nombres y direcciones de otros ejecutivos, directivos e inversores del sector. Y tenía, según la fiscalía, la intención de matar.

Dos días después, otras dos personas —de 25 y 23 años— dispararon contra la misma casa desde un auto.

Moreno-Gama enfrenta cargos de dos intentos de homicidio y tentativa de incendio intencional en la justicia de California, más cargos federales por posesión de armas no registradas y daño a instalaciones por explosivos. Su abogado defensor declaró que su cliente atravesaba "una crisis aguda de salud mental." El texto del expediente federal lo describe de otra manera: alguien que creyó genuinamente que la inteligencia artificial causaría la extinción de la humanidad y decidió actuar.

El concejal que apoyó un centro de datos

Seis días antes, el 6 de abril, alguien disparó 13 veces contra la puerta de la casa de Ron Gibson, concejal de la ciudad de Indianápolis. Gibson había expresado públicamente su apoyo a la construcción de un nuevo centro de datos. La persona que disparó dejó una nota que decía "No a los centros de datos."

Nadie resultó herido en ninguno de los dos incidentes. Pero la combinación —un CEO de IA atacado con explosivos improvisados, un funcionario local atacado por apoyar infraestructura de computación— encendió una discusión que ya llevaba meses cocinándose en silencio: ¿el rechazo popular a la inteligencia artificial está cruzando un umbral?

Los números detrás del malestar

El ambiente no apareció de la nada. Hay datos que lo sostienen.

El Stanford AI Index 2026, publicado este mes, encontró que el 52% de la población mundial se siente "nerviosa" respecto a productos de inteligencia artificial —dos puntos más que el año anterior. En Estados Unidos, esa cifra sube al 64%. Dos tercios de los estadounidenses creen que la IA eliminará empleos en las próximas dos décadas.

Una encuesta de Gallup midió algo más específico: el entusiasmo de la Generación Z hacia la IA cayó del 36% al 22% en un solo año. La rabia, en ese mismo período, subió del 22% al 31%. Son números que reflejan algo más que desconfianza abstracta: reflejan la percepción de que esta tecnología está afectando directamente las oportunidades de trabajo de gente joven que recién entra al mercado laboral.

Y luego están los centros de datos. En los últimos dos años, comunidades en todo Estados Unidos frenaron o retrasaron proyectos por un valor total de 64.000 millones de dólares. En un pueblo de 12.000 habitantes en las afueras de San Luis, los votantes removieron a todos los miembros titulares del consejo municipal después de que aprobaran un proyecto de centro de datos en la zona. El rechazo va más allá de las personas con carteles anti-tecnológicos: es el voto silencioso de comunidades que calculan que el centro de datos les va a subir la factura de electricidad y consumir el agua local.

Por qué los expertos ven algo más que casos aislados

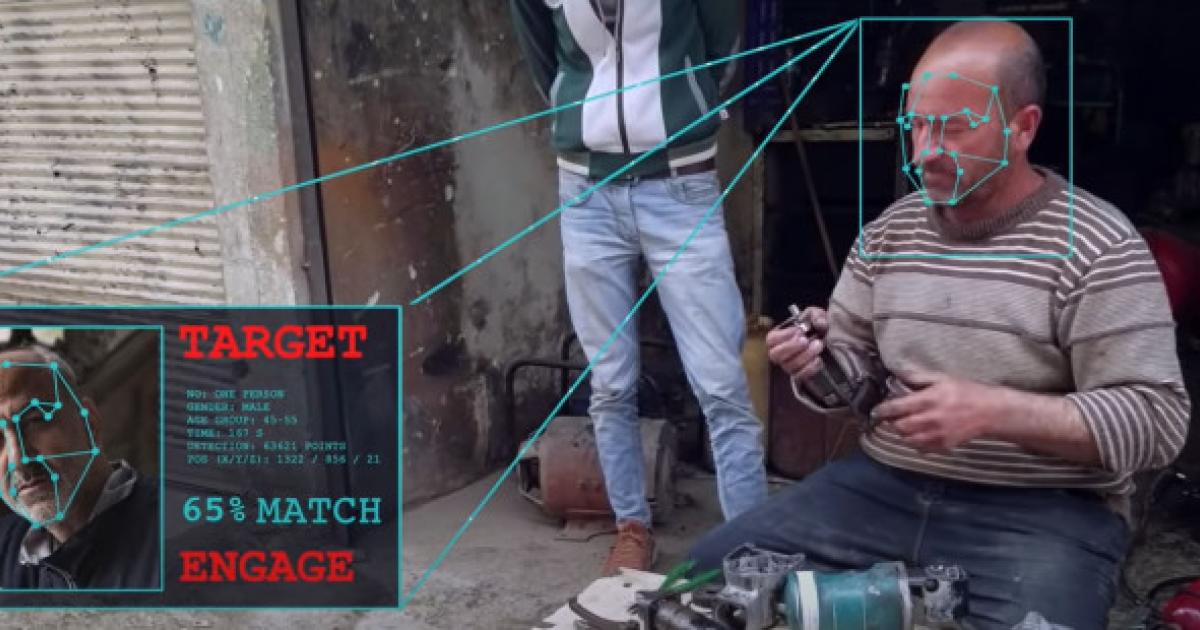

La investigadora Nirit Weiss-Blatt, especializada en pánico tecnológico, dice que la ansiedad ante tecnologías emergentes no es nueva, pero que con la inteligencia artificial "parece más extremo." Su hipótesis sobre los ataques es incómoda pero directa: la retórica sobre el "riesgo existencial de la IA" —la que usan los propios líderes del sector, incluido el fundador de OpenAI— puede estar radicalizando a personas vulnerables. Cuando alguien en posición de autoridad dice repetidamente que esta tecnología podría exterminar a la humanidad, hay quienes deciden que eso justifica la acción.

El profesor de Relaciones Internacionales Mauro Lubrano, de la Universidad de Bath, rechaza clasificar los ataques como incidentes aislados protagonizados por individuos perturbados. Los perpetradores, dice, están integrados en "una especie de ecosistema digital" donde el rechazo a la IA tiene su propia infraestructura de ideas, foros y narrativas.

El economista Aleksandar Tomic, de Boston College, traza el paralelo histórico que muchos evitan: la Segunda Revolución Industrial. "Es tentador decir que esto es solo un individuo perturbado, que probablemente lo es, pero realmente veo los paralelos con aquella época." Lo que no agrega —aunque está en los libros de historia— es que esa revolución tardó cincuenta años en resolverse, y tuvo dos guerras mundiales en el camino.

El movimiento ludita del siglo XIX no fue, como se lo caricaturizó después, el de trabajadores irracionales que rompían máquinas por miedo al futuro. Fue una respuesta organizada de artesanos textiles que vieron que la industrialización destruía su modo de vida sin ofrecerles nada a cambio. La narrativa de "los luditas estaban equivocados" se construyó décadas después, cuando ya había una clase trabajadora industrial. En el momento, la destrucción era real.

El problema de la narrativa disponible

Hay algo que distingue el rechazo a la IA de otras resistencias tecnológicas del pasado. Los argumentos contra la IA vienen de dos direcciones simultáneas que normalmente no coexisten: los que temen que destruya empleos y los que temen que destruya a la humanidad. Moreno-Gama, según el expediente judicial, pertenecía al segundo grupo. Los concejales y comunidades que rechazan los centros de datos pertenecen al primero.

Lo llamativo es que estas dos versiones del problema tienen muy poco en común ideológicamente. Una es materialista —trabajo, electricidad, agua, plata—. La otra es casi escatológica —extinción, control, fin de lo humano—. Sin embargo, producen la misma acción: oposición.

Valerie Sizemore, cofundadora de Stop AI, lo dijo con claridad después de los ataques: "La violencia no servirá de nada." Y también dijo algo más útil: espera que estos episodios generen un diálogo público real sobre hacia dónde va la tecnología y quién decide. Hasta ahora, ese diálogo estuvo notablemente ausente.

Los 38% de estadounidenses que dicen tener una visión positiva de la IA —el nivel más bajo desde que existen datos— no generan noticias. El que arrojó un Molotov, sí.