Cuando le hacés una pregunta a ChatGPT, no busca la respuesta en una base de datos. No tiene un archivo con respuestas precargadas. No "piensa" en el sentido en que vos pensás.

Lo que hace es estadísticamente más extraño y más impresionante al mismo tiempo: predice cuál es la siguiente palabra más probable, dado todo lo que vino antes. Y lo hace una palabra a la vez, hasta que la respuesta está completa.

El truco fundamental: predecir la siguiente palabra

Los modelos de lenguaje como GPT fueron entrenados en cantidades masivas de texto — libros, artículos, código, conversaciones de internet. Durante el entrenamiento, el modelo aprendió a responder una pregunta muy simple: dado este texto, ¿cuál es la palabra que más probablemente viene después?

Si el texto dice "El cielo es de color", la respuesta más probable es "azul". Si dice "La capital de Francia es", la respuesta más probable es "París".

Eso parece trivial. Pero cuando el modelo tiene suficientes parámetros — GPT-4 tiene estimadamente 1 billón de parámetros — y fue entrenado en suficiente texto, esa capacidad de predecir la siguiente palabra produce algo que en la práctica parece razonamiento, explicación, y hasta creatividad.

Qué son los parámetros

Los parámetros son números. Billones de números que fueron ajustados durante el entrenamiento para que las predicciones fueran más precisas. No son reglas escritas a mano ni conocimiento explícito — son pesos numéricos en una red de conexiones.

Cuando el modelo procesa texto, esos números interactúan de maneras extremadamente complejas para producir la predicción siguiente. El "conocimiento" del modelo está distribuido en todos esos parámetros, no almacenado en ningún lugar específico.

Por qué parece que entiende

La pregunta filosófica más interesante sobre los modelos de lenguaje es si "entienden" lo que dicen o solo producen texto que suena coherente.

La respuesta honesta es que no lo sabemos con certeza. Lo que sí sabemos es que para producir texto coherente sobre un tema complejo, el modelo tiene que capturar alguna representación interna de las relaciones entre conceptos. Cuando explica bien la relatividad o resuelve un problema de lógica, está activando estructuras internas que capturan algo de cómo esos temas funcionan.

Si eso cuenta como "entender" depende de cómo definas entender. Los modelos de lenguaje rompieron la intuición de que la comprensión y la generación de texto son cosas completamente separadas.

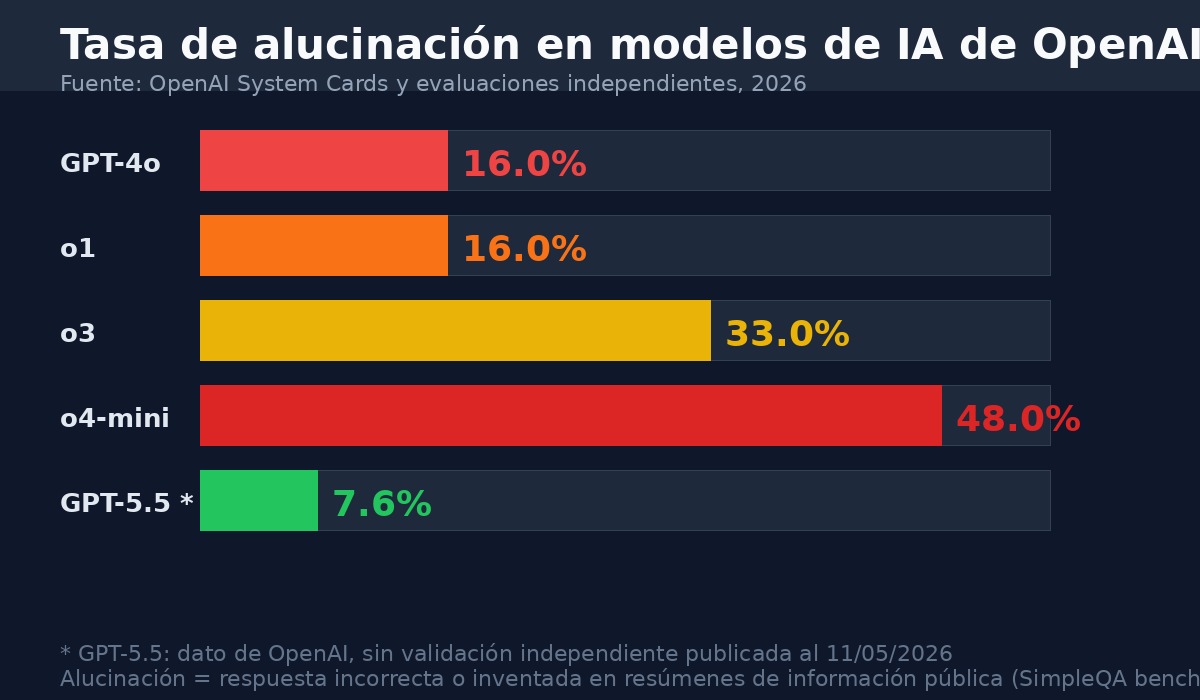

Por qué a veces inventa cosas (alucinaciones)

Los modelos alucina — producen información falsa con total confianza — por una razón que tiene que ver con su mecanismo central.

El modelo predice la palabra más probable. Si la pregunta es sobre algo que no estaba en los datos de entrenamiento, o sobre algo muy específico, el modelo sigue generando texto "plausible" aunque la información sea incorrecta. No tiene un mecanismo para decir "no sé" automáticamente — tiene que ser entrenado explícitamente para hacer eso, y aun así no es perfecto.

La alucinación no es un bug que se puede parchar con una actualización. Es una consecuencia estructural de cómo funcionan los modelos de lenguaje.

La diferencia entre GPT-3, GPT-4 y los modelos más recientes

Los modelos más nuevos no funcionan de manera fundamentalmente diferente. La diferencia es de escala y de entrenamiento adicional.

GPT-4 tiene más parámetros que GPT-3 y fue entrenado con más datos y con técnicas adicionales de alineación — básicamente, fue ajustado para ser más útil, menos propenso a dar respuestas dañinas, y mejor siguiendo instrucciones.

Los modelos de razonamiento más recientes (como la familia o1 de OpenAI o los modelos con "thinking" extendido) agregan una capa adicional: antes de dar la respuesta, "piensan" en pasos intermedios, lo que mejora dramáticamente el rendimiento en problemas matemáticos y lógicos complejos.

La arquitectura base — predecir la siguiente palabra — sigue siendo la misma.

---

Fuente original: Un Mundo Loco

Fuentes consultadas: OpenAI — GPT-4 Technical Report · Attention Is All You Need — Vaswani et al.