En 2009, un grupo de investigadores de Princeton y Stanford presentó ImageNet, una base visual pensada para entrenar software de reconocimiento de objetos a una escala que hasta entonces no existía. El proyecto, liderado por Li Fei-Fei, Jia Deng y Kai Li, organizó millones de fotografías según la jerarquía léxica de WordNet y convirtió una pregunta académica en infraestructura concreta. Importa porque buena parte de la visión artificial moderna se apoyó en ese piso.

El dato más fuerte está en la magnitud. El sitio oficial de ImageNet informa 14.197.122 imágenes y 21.841 synsets indexados. Para la competencia ILSVRC 2012, el proyecto recortó ese universo a 1.000 categorías y 1,2 millones de imágenes de entrenamiento, más 150.000 fotografías de validación y test. Ese recorte bastó para reordenar un campo entero: en septiembre de 2012, el equipo SuperVision de la University of Toronto bajó el error top-5 a 15,315%, frente al 26,172% del siguiente sistema, y dejó marcado el momento en que las redes neuronales profundas pasaron de promesa a método dominante.

Un diccionario visual montado sobre WordNet

ImageNet no nació como una simple carpeta gigante de fotos. Nació como un cruce entre lingüística, estadística y trabajo humano distribuido. Su estructura toma como columna vertebral a WordNet, la base léxica creada en Princeton por George A. Miller, donde cada concepto se organiza en un synset, es decir, un conjunto de palabras que apuntan a una misma idea. ImageNet tomó esa arquitectura y la volvió visual: para cada concepto, el objetivo era reunir en promedio unas 1.000 imágenes.

La consecuencia fue menos obvia de lo que parece. El dataset no quedó ordenado por carpetas arbitrarias sino por una ontología. “Perro”, “globo”, “fresa” o “puente colgante” no eran etiquetas sueltas: eran nodos dentro de un árbol más grande. No ofrecía sólo muchas imágenes. Ofrecía una gramática para etiquetarlas.

La competencia de 2012 que cambió el ritmo del campo

La gran escena pública de ImageNet fue el ImageNet Large Scale Visual Recognition Challenge, conocido como ILSVRC, que se corrió entre 2010 y 2017. La edición de 2012 sigue siendo la bisagra. En los resultados oficiales aparecen dos familias de métodos enfrentadas con nitidez. De un lado, sistemas basados en SIFT, LBP, GIST y clasificadores lineales. Del otro, la red profunda de Alex Krizhevsky, Ilya Sutskever y Geoffrey Hinton.

La ficha del equipo SuperVision resume bien el salto. Su modelo tenía 60 millones de parámetros, 650.000 neuronas, cinco capas convolucionales y tres capas totalmente conectadas. Fue entrenado durante aproximadamente una semana sobre dos GPU NVIDIA. El margen de más de diez puntos porcentuales frente al segundo puesto fue la señal de que el centro técnico de la visión por computadora se había movido.

Desde entonces, “momento ImageNet” se volvió una fórmula frecuente para nombrar cualquier quiebre parecido. El problema es que esa frase suele quedarse con la competencia y olvidar el archivo. Sin el trabajo previo de recolección, limpieza y anotación, el hito de 2012 no hubiera tenido dónde ocurrir.

Cincuenta mil personas etiquetando un mundo prestado

El propio proyecto aclara un punto importante: ImageNet no es dueño de las fotos. Compila URLs y anotaciones de imágenes encontradas en la web para uso de investigación y educación no comercial. Esa condición muestra la naturaleza híbrida del archivo. Es una capa de organización montada sobre imágenes ajenas.

Según la actualización publicada por el equipo en septiembre de 2019, la construcción de ImageNet involucró más de 50.000 trabajadores y más de 160 millones de imágenes candidatas. Para llegar a una versión usable hubo que automatizar descargas, repartir tareas a trabajadores de Amazon Mechanical Turk y decidir qué conceptos eran realmente visibles en una foto y cuáles no.

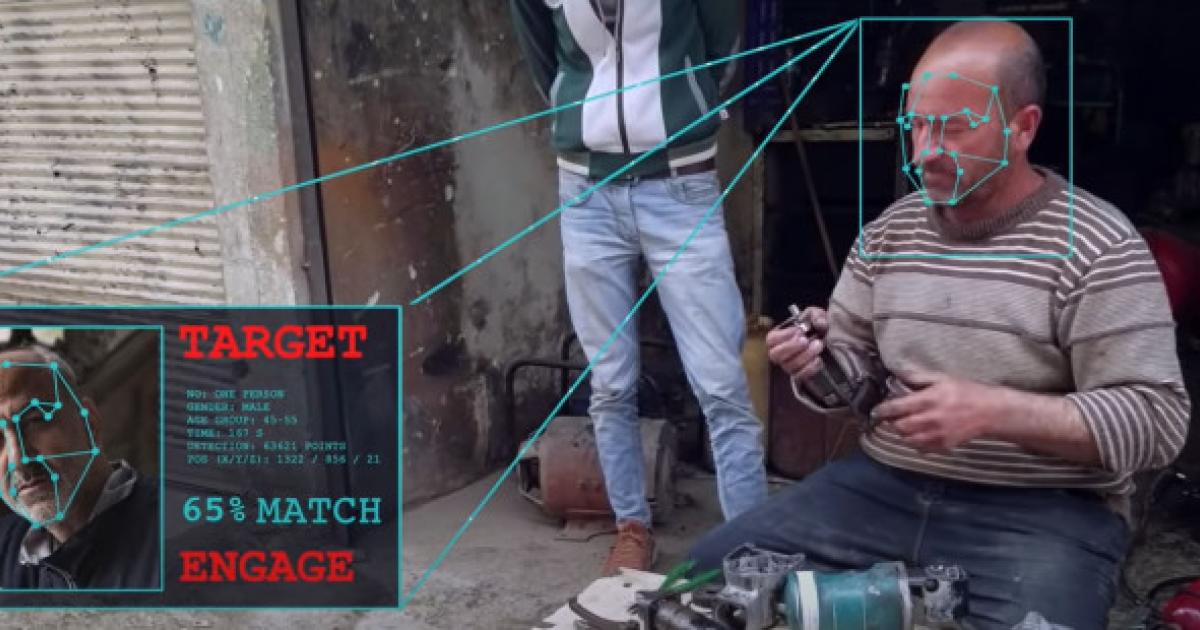

La propia documentación del equipo pone un ejemplo incómodo: conceptos como philanthropist pueden existir en WordNet, pero no necesariamente son “imageables”. Si un concepto no se puede identificar de manera fiable por rasgos visuales, el dataset corre el riesgo de reemplazar una definición por un estereotipo.

Cuando el dataset tuvo que corregir su propio vocabulario

Esa tensión estalló con más fuerza en el subárbol de personas. En 2019, el equipo de Kaiyu Yang, Klint Qinami, Li Fei-Fei, Jia Deng y Olga Russakovsky publicó una revisión específica sobre equidad y representación. Allí informó que el árbol de `person` dentro de ImageNet contenía 2.832 categorías y que muchas podían derivar en clasificaciones ofensivas, sensibles o directamente no visualizables.

La respuesta fue concreta. El proyecto anunció que, desde enero de 2019, había deshabilitado la descarga del dataset completo salvo el subconjunto clásico de 1.000 categorías del challenge. También informó que había identificado 1.593 synsets inseguros y que preparaba una nueva versión con la remoción de 600.040 imágenes, lo que dejaba 577.244 imágenes en los synsets considerados seguros. En marzo de 2021, una nueva actualización del sitio agregó otro dato: el equipo ya había filtrado 2.702 synsets problemáticos del subárbol de personas.

Ese giro volvió a ImageNet un caso de estudio sobre gobernanza de datos, no sólo sobre rendimiento de modelos. La discusión conecta de manera directa con intentos más recientes de documentar mejor los sistemas de IA, desde los datasets con etiqueta nutricional hasta las model cards. El punto ya no es reunir más datos porque sí. Es poder explicar qué representan, qué dejan afuera y qué tipo de errores vuelven probables.

El archivo que sigue ahí aunque el campo ya haya cambiado

Los sistemas visuales más grandes ya se entrenan con corpus multimodales mucho más extensos y menos transparentes que ImageNet. Aun así, el dataset conserva un lugar raro. Ya no funciona sólo como combustible técnico, sino como documento histórico de una etapa de la IA en la que todavía se podía inspeccionar con bastante precisión de qué material estaba hecha una revolución.

Por eso ImageNet sigue importando. No sólo porque empujó la visión artificial moderna, sino porque dejó visible una lección menos cómoda: un dataset también es una teoría del mundo. Decide qué categorías parecen naturales, qué imágenes cuentan como evidencia y qué diferencias vale la pena medir. La pregunta técnica e histórica que deja abierta no perdió fuerza: si una máquina aprende a mirar con archivos armados por personas, cuánto de esa mirada pertenece al algoritmo y cuánto al vocabulario, a la selección y a los recortes de quienes construyeron el archivo.

Fuente original: ImageNet