Hay un test que conoce todo el mundo: marcar las imágenes que contienen semáforos o bicicletas para demostrar que sos humano. Se llama CAPTCHA. Fue inventado en 2000. Durante veinte años fue suficiente para separar personas de bots.

En 2025, los bots de IA pasaron el CAPTCHA con tasas de éxito superiores al 99 por ciento. El sistema que distinguía humanos de máquinas dejó de funcionar.

Kibu, una startup americana, levantó 10,5 millones de dólares en su ronda semilla para resolver el problema. La demanda de sistemas de verificación de identidad digital creció exponencialmente en los últimos 18 meses. El mercado que está emergiendo tiene nombre: "proof of humanity", prueba de humanidad.

Por qué el problema es más grave de lo que parece

Un bot que supera un CAPTCHA puede crear una cuenta de correo electrónico. Puede registrarse en una red social. Puede dejar reseñas de productos. Puede votar en encuestas. Puede participar en foros. Puede aplicar a ofertas de trabajo. Puede hacer compras. Puede abrir una cuenta bancaria en algunos sistemas menos rigurosos.

El volumen de actividad falsa en internet ya no es marginal. Estimaciones de empresas de ciberseguridad como Imperva indican que en 2025 el 49 por ciento del tráfico web global fue generado por bots. Casi la mitad de la actividad en internet no fue humana.

Eso tiene consecuencias concretas. Las empresas que pagan publicidad digital pagan por impresiones que nadie vio. Los sistemas de reputación de productos y servicios están contaminados. Las plataformas de redes sociales no pueden distinguir cuántos de sus "usuarios" son personas reales. Los procesos electorales que usan plataformas digitales son vulnerables a campañas de desinformación generadas y amplificadas por bots sofisticados.

El impacto más nuevo y más disruptivo es en los sistemas de IA conversacional: un agente de IA puede hablar con otro agente de IA indefinidamente, generar transacciones, firmar contratos, crear contenido, todo sin ningún humano involucrado. Project Deal, el experimento de Anthropic con mercados de agentes, demostró que eso ya es posible. La pregunta es quién controla qué agente y con qué objetivo.

Cómo funciona la verificación de identidad moderna

La solución que Kibu y otras empresas del espacio están desarrollando tiene varias capas.

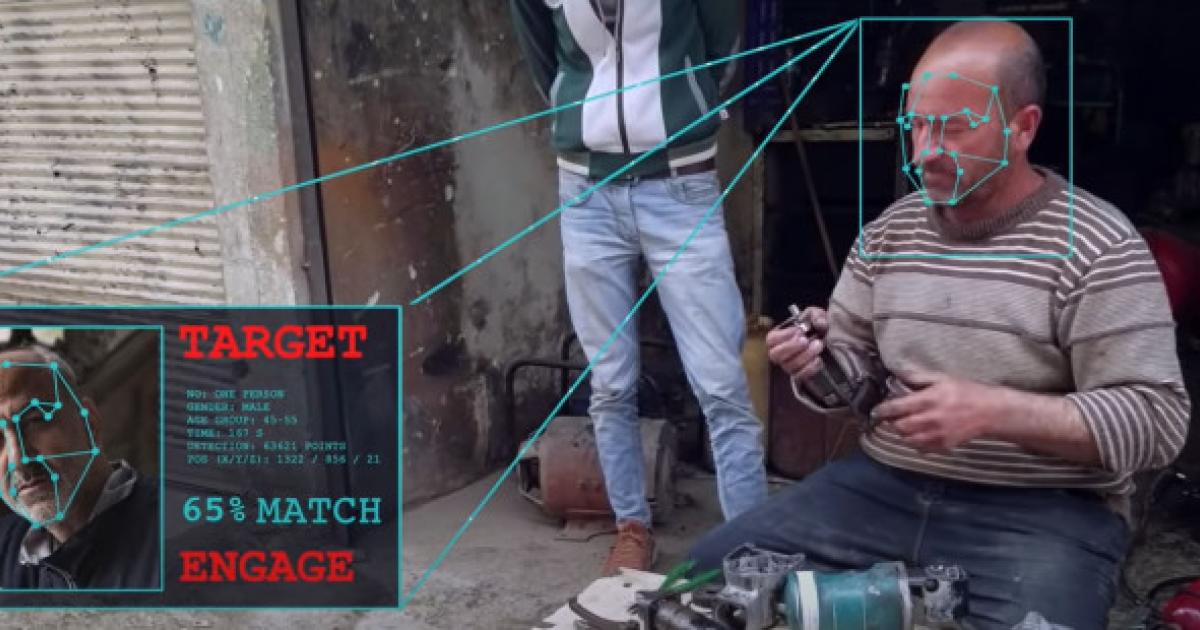

La verificación biométrica es la más directa: reconocimiento facial, escaneo de iris o huella digital. Si el sistema puede verificar que hay una cara humana real detrás de la cámara, tiene una señal fuerte de que el usuario es persona. El problema es que los deepfakes —rostros falsos generados por IA— ya superan muchos sistemas de reconocimiento facial convencionales.

La verificación de documentos es otra capa: pasaporte, DNI, licencia de conducir. Más difícil de falsificar que una cara, pero también más invasiva para el usuario y con fricciones regulatorias en distintas jurisdicciones.

El análisis comportamental es la capa menos invasiva: los sistemas analizan la forma en que el usuario tipea, mueve el mouse, hace scroll, cuánto tarda entre acciones. Los humanos tienen patrones biométricos en su comportamiento digital que los bots no replican de manera natural. Este tipo de análisis funciona en segundo plano, sin que el usuario tenga que hacer nada.

La combinación de estas capas —biometría, documentos, comportamiento— es lo que los sistemas más avanzados están integrando. Kibu apunta específicamente a plataformas para adolescentes, donde la verificación de edad es una obligación legal creciente y donde los padres quieren garantías de que sus hijos no están interactuando con cuentas controladas por adultos o por bots.

El modelo de Worldcoin y sus problemas

La solución más radical al problema de la identidad digital es la que Sam Altman propuso con Worldcoin, ahora rebautizado World: un escáner de iris que verifica que sos humano a nivel biológico y te da tokens criptográficos a cambio de esa verificación.

El sistema tiene la ventaja de ser prácticamente infalsificable: dos personas no tienen el mismo iris. Pero tiene problemas que la verificación por iris no resuelve.

Primero, el problema de la centralización: alguien tiene que controlar el registro de irises verificados. Hoy ese alguien es Tools for Humanity, la empresa de Altman. Eso concentra un poder enorme en una entidad privada.

Segundo, el problema de la exclusión: en el mundo hay personas sin documentos, sin acceso a los orbes de escaneo de Worldcoin, sin smartphones compatibles. Un sistema de identidad universal que no incluye a todos los humanos crea una clase de personas digitalmente inexistentes.

Tercero, el problema de la revocación: si tu iris queda comprometido —si alguien roba la base de datos— no podés cambiar tu iris. No como una contraseña. La biometría es permanente.

El mercado que nació del caos

Las startups de verificación de identidad no estaban en la agenda de los inversores en 2022. En 2026 reciben rondas semilla de decenas de millones de dólares.

El catalizador fue simple: la IA generativa democratizó la capacidad de crear identidades falsas convincentes. Eso creó un problema que los sistemas existentes no podían resolver. Los problemas que los sistemas existentes no pueden resolver crean mercados nuevos.

El negocio de probar que sos humano va a ser uno de los más importantes de los próximos diez años. La pregunta que todavía no tiene respuesta es quién va a controlarlo.

Fuente original: Un Mundo Loco