El 1 de abril de 2026, MLCommons publicó los resultados de MLPerf Inference v6.0, la nueva versión de uno de los bancos de pruebas más usados para comparar rendimiento de sistemas de inteligencia artificial. La actualización importa porque no agregó una prueba más a una lista estable: cambió el contenido mismo del examen. El consorcio reemplazó o actualizó cinco de sus once pruebas de datacenter, incorporó una nueva detección para edge y movió el foco hacia tareas que hoy sí están entrando en producción, desde modelos de razonamiento hasta video generado por IA.

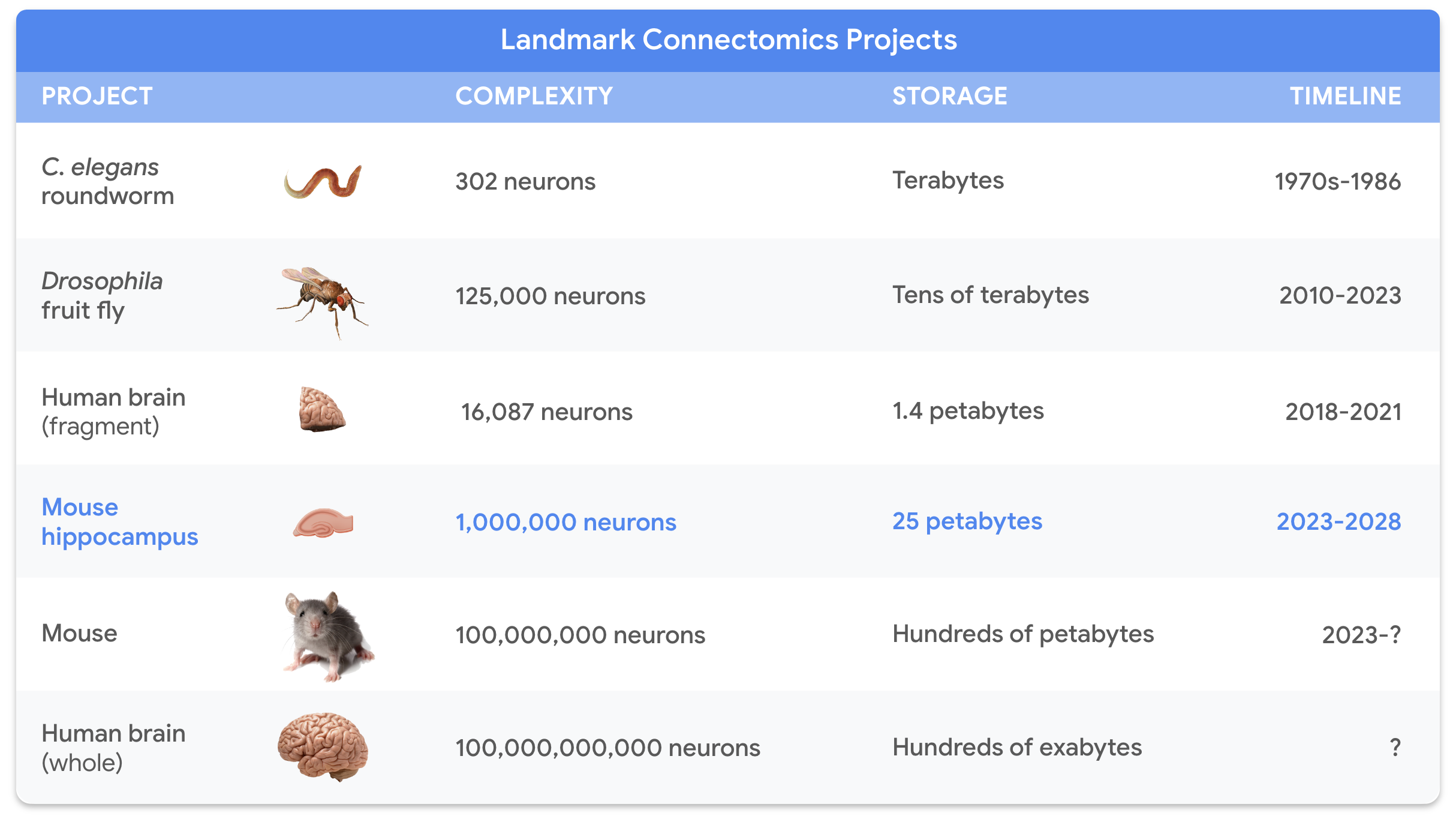

El dato más fuerte es la escala del cambio. La documentación de MLPerf v6.0 muestra 17 workloads activos entre edge y datacenter, con entradas nuevas como GPT-OSS 120B, DeepSeek-R1, un benchmark de video basado en Wan2.2, un benchmark multimodal con catálogo de Shopify y el reemplazo de RetinaNet por YOLOv11. En paralelo, MLCommons informó que las presentaciones con sistemas multinodo crecieron 30% respecto de la ronda 5.1, que el 10% de los sistemas enviados tenía más de diez nodos y que el mayor montaje evaluado llegó a 72 nodos y 288 aceleradores.

El benchmark dejó de mirar sólo texto e imagen fija

MLPerf existe para una pregunta simple y difícil a la vez: cuán rápido corre un sistema de IA una carga de trabajo definida, de manera reproducible y comparable. El problema es que la industria cambió demasiado rápido. Un benchmark útil en 2024 podía quedar viejo en 2026 si seguía midiendo familias de modelos que ya no representan lo que empresas y laboratorios están desplegando.

Por eso la v6.0 no se limitó a actualizar resultados. Según MLCommons, esta ronda añadió un benchmark para GPT-OSS 120B, un modelo abierto orientado a matemática, razonamiento científico y código; expandió DeepSeek-R1 con un escenario interactivo de baja latencia para razonamiento en tiempo real; incorporó DLRMv3 como nueva generación de recomendación secuencial; sumó el primer benchmark de texto a video del paquete y estrenó una prueba vision-language model basada en Qwen3-VL-235B-A22B-Instruct y el Shopify Product Catalogue. En el extremo edge, también retiró a RetinaNet y lo sustituyó por YOLOv11 Large para detección de objetos.

La rareza no está en un nombre de moda sino en la convivencia de tareas muy distintas dentro de un mismo estándar. En la misma tabla aparecen ResNet50, BERT, Whisper, Llama 3.1 405B, Mixtral-8x7B, PointPainting, Wan2.2-T2V-A14B-Diffusers y un VLM para comercio electrónico. Hoy “medir IA” ya no significa medir una sola clase de modelo.

GPT-OSS, DeepSeek y Shopify cambiaron el contenido del examen

Las piezas nuevas no entraron por capricho. En su nota técnica del 24 de marzo, MLCommons explicó que GPT-OSS 120B llega a la suite por una razón concreta: representa una familia de modelos abiertos capaces de trabajar en código, lógica científica y matemática avanzada. El benchmark lo describe como una arquitectura mixture-of-experts con 117.000 millones de parámetros totales y 5.100 millones de parámetros activos por token. Eso no dice sólo cuán grande es el modelo. Dice qué tipo de inferencia quieren medir ahora los proveedores de hardware.

DeepSeek-R1 empujó otro cambio importante. MLPerf añadió un escenario interactivo con restricciones de latencia y lo presentó como su primer estándar para speculative decoding. La diferencia es técnica pero relevante: no basta con responder bien; también hay que responder bajo un presupuesto temporal compatible con productos reales.

El benchmark multimodal empuja el mismo argumento desde otro ángulo. La prueba usa Qwen3-VL-235B-A22B-Instruct junto con el catálogo de productos de Shopify, publicado el 12 de diciembre de 2025, para clasificación y comprensión de mercancías. MLCommons lo justifica por la escala del comercio digital: millones de comerciantes, miles de millones de productos y necesidad de convertir imágenes y texto desordenados en metadatos utilizables.

El video entró al benchmark y ya no como curiosidad

La entrada más llamativa de v6.0 es el texto a video. MLCommons montó la prueba sobre Wan2.2 y VBench y la presentó el 10 de marzo de 2026 como su primer benchmark específico de generación de video. El gesto es más importante que el nombre del modelo elegido. Al llevarla a MLPerf, una capacidad que hasta hace poco circulaba como demo vistosa pasa a ser una carga de trabajo con reglas, datasets y métricas de ejecución.

La actualización de YOLOv11 en el lado edge cumple una función parecida, aunque menos espectacular. MLCommons reconoce que RetinaNet había quedado atrás en adopción y ritmo de desarrollo. Pasar a YOLOv11 acerca la suite a un modelo con uso más extendido en visión por computadora contemporánea. Un benchmark gana autoridad cuando no se aferra demasiado tiempo a pruebas que la práctica ya dejó atrás.

Lo que los números cuentan sobre la infraestructura

Los resultados de abril también muestran otra capa del problema: la carrera ya no se juega sólo en un servidor aislado. MLCommons informó que las presentaciones con sistemas multinodo subieron 30% frente a la ronda 5.1, celebrada seis meses antes. El porcentaje de sistemas con más de diez nodos saltó del 2% al 10%.

El caso extremo fue un sistema de 72 nodos y 288 aceleradores. Más que una cifra de récord, funciona como síntoma. Correr inferencia sobre modelos grandes, multimodales o interactivos exige optimizar red, almacenamiento, software de serving y reparto de memoria entre máquinas. Por eso v6.0 también estrenó LoadGen++, un nuevo harness que permite ejecutar pruebas de LLM con una pila de serving más parecida a los despliegues reales.

Ese punto conecta con dos discusiones ya instaladas en el campo: qué información mínima debería acompañar a un sistema de IA y cómo se documenta de manera útil. El rendimiento bruto sirve, pero no alcanza, igual que ocurre con las model cards o con los datasets con etiqueta nutricional.

Qué cambió realmente en MLPerf 6.0

El cambio de fondo no es que la IA sea más rápida que hace seis meses. Es que el examen con el que la industria compara esa velocidad se volvió más parecido a la IA que efectivamente está intentando vender. MLCommons, Frank Han, Miro Hodak, Glenn Jocher y Kshetrajna Raghavan aparecen en esta ronda como señales de un consenso técnico: si el benchmark no incorpora razonamiento, video, multimodalidad, recomendación secuencial y escalado multinodo, deja de describir el presente.

Queda una pregunta práctica. Si MLPerf ya tuvo que reescribir casi la mitad de sus pruebas de datacenter en una sola versión, cuánto tiempo puede seguir siendo estable un estándar en un sector donde los modelos, los datasets y las cargas reales cambian más rápido que los ciclos clásicos de hardware. La v6.0 no resuelve ese problema. Lo hace visible.

Fuente original: MLCommons