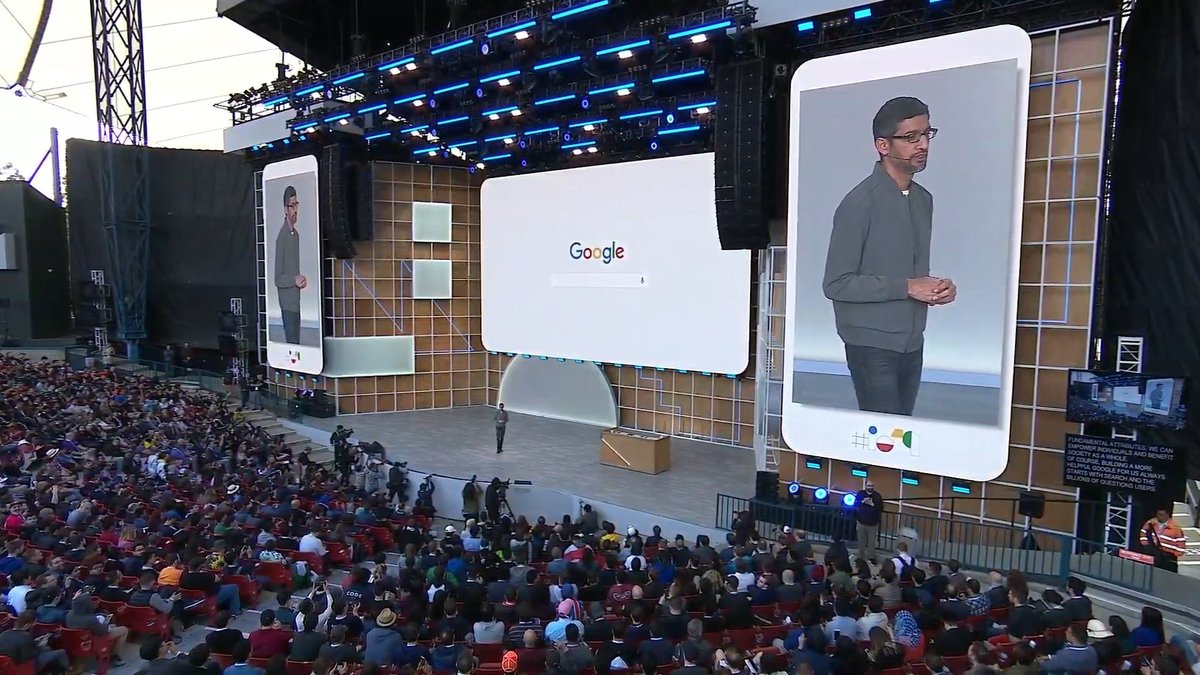

La última vez que Google entró al Shoreline Amphitheatre para su conferencia anual de desarrolladores, el tema central era la transición de modelos de lenguaje a asistentes integrados en productos. En ocho días, el 19 de mayo de 2026, entra de nuevo. El tema de este año no es una transición: es la demostración de que esa transición ya ocurrió, y que lo que sigue es diferente en tipo, no en grado.

Google I/O 2026 arranca con keynote el 19 de mayo a las 10 AM PT (14:00 hora de Buenos Aires, 19:00 en España) con streaming gratuito. El 20 de mayo continúan las sesiones técnicas para desarrolladores. Pero antes de eso, el 12 de mayo —mañana— Google transmite "The Android Show | I/O Edition", un evento separado para consumidores donde se esperan los primeros anuncios sobre Android 17.

La señal de lo que viene ya llegó antes del evento: Google y Boston Dynamics anunciaron que los modelos Gemini Robotics van a integrarse en los robots Atlas de producción. OpenAI lanzó GPT-5.5 la semana pasada. El mercado de IA en 2026 no espera los eventos para moverse.

El cambio conceptual: de IA generativa a IA agéntica

Los últimos tres años de Google I/O estuvieron dominados por la generación de contenido: texto, imágenes, código, video. Los modelos hacían cosas por instrucción directa y producían un resultado. El marco de este año es distinto: IA agéntica, sistemas que no solo generan sino que ejecutan tareas complejas con autonomía mínima.

La diferencia es concreta. Un sistema generativo responde a la pregunta "¿cómo reservo un vuelo?" con instrucciones. Un sistema agéntico recibe "reservame un vuelo a Madrid el 3 de junio con menos de una escala y menos de 800 dólares" y lo hace: abre el buscador, compara opciones, introduce los datos de pago y confirma la reserva. Sin que el usuario toque nada.

Google lleva dos años desarrollando los componentes para esto: los modelos Gemini con contexto largo, Project Astra como interfaz de asistente universal, y las integraciones con los servicios de Google (Gmail, Calendar, Maps, Search, Drive). El anuncio en I/O no será que esto existe —ya existe en forma preliminar— sino que está lo suficientemente maduro para ser lanzado como producto a escala.

Gemini 4: lo que se sabe antes del anuncio

Los rumores técnicos sobre Gemini 4 apuntan en tres direcciones verificables: mayor capacidad de ventana de contexto (potencialmente 2 millones de tokens o más), mejor desempeño en razonamiento multi-paso, y reducción de latencia para aplicaciones en tiempo real.

Google tiene un problema estratégico que resolver con este lanzamiento. Su modelo actual, Gemini 2.0, está compitiendo en un mercado donde OpenAI lanzó GPT-5.5, Anthropic tiene Claude Opus 4 y Meta publica modelos de código abierto que cualquiera puede desplegar. La ventaja competitiva de Google no está solo en el modelo sino en la integración: Gemini integrado en Search, en Maps, en YouTube, en el sistema operativo Android, en las Chromebooks, en Google Workspace. Eso es un canal de distribución que ningún competidor tiene.

Gemini 4 con acceso integrado a todos esos servicios y con capacidades agénticas reales sería un producto diferente a cualquier modelo de lenguaje que se pueda usar suelto a través de una API.

El nivel de suscripción "Neon" que Google está desarrollando —posicionado entre los planes Pro y Ultra, con un precio estimado de 100 dólares por mes— sugiere que hay una versión de Gemini más capaz que el nivel Pro actual, diseñada para uso profesional intensivo. I/O 2026 sería el momento natural para revelarla.

Android 17 y Aluminium OS: plataformas para la IA en el bolsillo

Android 17 está en camino con fecha estimada de lanzamiento en junio, y Google I/O será su presentación formal. Las mejoras esperadas incluyen optimizaciones para procesadores diseñados específicamente para inferencia de IA (los NPUs de los chips Tensor de Google y los chips Snapdragon más recientes de Qualcomm), gestión de memoria más eficiente para multitarea con contextos largos, y mejoras en la interfaz para pantallas plegables y grandes.

El anuncio más inesperado puede ser Aluminium OS, el nuevo sistema operativo que Google tiene en desarrollo. Los detalles previos al evento son escasos: se sabe que apunta a dispositivos distintos de smartphones y laptops, posiblemente tablets y dispositivos de productividad de nuevo tipo. Si Google lo presenta en I/O, sería la primera vez que la empresa lanza un nuevo sistema operativo en más de una década.

Las gafas de IA con Warby Parker

Uno de los anuncios más concretos que circularon antes del evento es la colaboración entre Google y Warby Parker para producir gafas con IA integrada. El precedente es Google Glass, lanzadas en 2013 y retiradas después de generar rechazo cultural por sus implicaciones para la privacidad.

La diferencia en 2026 es técnica y de contexto. Los modelos de visión de Gemini son lo suficientemente capaces para procesar video en tiempo real y responder preguntas sobre lo que la cámara ve. Los auriculares inalámbricos se normalizaron como accesorio de uso diario, creando tolerancia cultural para usar tecnología en el oído. Y el mercado de wearables de IA tiene en Meta AI Glasses un precedente comercial relativamente exitoso.

La versión con Warby Parker apunta a un diseño que no parezca tecnológico: lentes ópticos convencionales con procesamiento de IA discreto. Si el precio es razonable y la integración con Gemini funciona en tiempo real, el producto podría tener una recepción completamente distinta a la de las Glass originales.

Project Astra y la pregunta que I/O tiene que responder

Project Astra es el nombre interno del asistente de IA universal que Google mostró como demostración en I/O 2024 y 2025. En esas versiones, Astra podía procesar video en tiempo real desde la cámara, responder preguntas sobre lo que estaba viendo, recordar conversaciones pasadas y actuar en aplicaciones. Las demos eran convincentes. El producto no estaba disponible para el público general.

I/O 2026 es el momento en que Google tiene que responder si Astra es un producto o sigue siendo una demostración. Dos años de demos sin lanzamiento es una señal de que algo en el sistema —latencia, confiabilidad, costo de inferencia, capacidad de escalar— no estaba listo para usuarios reales. Si este año Google lanza Astra como producto, eso dice que los últimos problemas se resolvieron. Si I/O pasa y Astra sigue siendo una demo, la pregunta se vuelve más difícil de responder.

El 19 de mayo, en el escenario de Mountain View, van a quedar pocas dudas sobre en cuál de los dos casos estamos.

---

Fuente original: Un Mundo Loco

Fuentes: Android Authority — What to Expect from Google I/O 2026 · Engadget — What to expect from Google I/O 2026 · Infobae — Google confirma la fecha del I/O 2026 · CriptoTendencia — Google I/O 2026: la gran apuesta por la IA agéntica · BusinessToday — Everything to expect at Google I/O 2026